Premiera Glm-5-turbo. Nowy model w GLM Coding Plan – idealny do OpenClaw i Claude Code?

Chiński startup Z.ai ogłosił 15 marca 2026 premierę GLM-5-Turbo — wersji high-speed flagowego modelu GLM-5, zoptymalizowanej pod workflow agentowe i zadania w stylu OpenClaw. Model jest już dostępny w planie Max GLM Coding Plan i trafia do niższych planów w ciągu najbliższych tygodni.

TL;DR: GLM-5-Turbo to zamknięta, szybsza wersja modelu GLM-5 (744B parametrów), osiągająca 55+ tokenów/sekundę. Kosztuje od $10/miesiąc w planie Lite i integruje się z Claude Code, Cline i OpenCode. Dostępny jest teraz w planie Max, w marcu trafi do Pro, a w kwietniu do Lite (Z.ai, 2026).

Czym jest GLM-5-Turbo i czym różni się od GLM-5?

GLM-5-Turbo to wariant modelu GLM-5 zaprojektowany od podstaw pod workflow agentowe — scenariusze, w których AI wykonuje długie łańcuchy operacji, wywołuje narzędzia i reaguje na zmiany w czasie rzeczywistym. Model bazuje na architekturze GLM-5 (744B parametrów, 40B aktywnych w MoE), ale jest zoptymalizowany pod kątem szybkości i niezawodności w zadaniach typu OpenClaw (GIGAZINE, 2026).

Kluczowa różnica: GLM-5 jest modelem open-source, podczas gdy GLM-5-Turbo pozostaje zamknięty jako wersja eksperymentalna. Z.ai zapowiedziało włączenie wszystkich usprawnień z Turbo do następnej wersji open-source modelu.

GLM-5-Turbo jest pozycjonowany nie jako statyczny chatbot, ale jako model zachowujący się podobnie do agentów w rzeczywistych operacjach. Priorytetem jest niezawodność w praktycznych przepływach zadań — szybka reakcja na komendy, skuteczne wywoływanie narzędzi i utrzymanie kontekstu przez długie sesje.

Jakie parametry techniczne ma GLM-5-Turbo?

Model oferuje prędkość generowania ponad 55 tokenów na sekundę, co umożliwia płynną interakcję w czasie rzeczywistym. Brak limitów sieciowych i blokad kont — w przeciwieństwie do niektórych konkurencyjnych rozwiązań (Z.ai Developer Docs, 2026).

Dostępność w planach:

- Max: dostępny teraz

- Pro: planowana dostępność pod koniec marca 2026

- Lite: planowana dostępność w kwietniu 2026

Wszystkie plany obsługują również modele GLM-4.7, GLM-4.6, GLM-4.5 i GLM-4.5-Air. Dodatkowo GLM Coding Plan obejmuje wsparcie dla MCP (Model Context Protocol): Vision Understanding, Web Search, Web Reader i Zread.

Czy warto wybrać GLM-5-Turbo do Claude Code?

Decyzja zależy od Twoich potrzeb i budżetu. Oto kluczowe argumenty za i przeciw.

Zalety:

- Szybkość: 55+ tokenów/sekundę zapewnia płynną pracę

- Cena: od $10/miesiąc — konkurencyjne względem Claude Pro

- Brak limitów sieciowych: brak blokad kont i rate-limitów

- MCP: wbudowane wsparcie dla Vision, Web Search i Reader

- Współpraca z wieloma narzędziami: Claude Code, Cline, OpenCode, OpenClaw

Ograniczenia:

- Closed-source: nie możesz uruchomić modelu lokalnie

- Dostępność: pełny dostęp wymaga planu Max ($50+)

- Mniejszy ekosystem: mniej integracji niż w przypadku Claude/GPT

W praktyce GLM-5-Turbo sprawdzi się najlepiej w zadaniach wymagających długich sesji agentowych — automatyzacji, refaktoryzacji kodu, czy pracy z dużymi bazami kodu. Do krótkich zapytań i prostych tasków różnica prędkości może być mniej zauważalna.

Jakie narzędzia obsługują GLM Coding Plan?

Plan jest kompatybilny z szeroką gamą narzędzi do programowania z AI (Z.ai, 2026):

- Claude Code — oficjalny CLI Anthropic

- Cline — rozszerzenie VS Code

- OpenCode — open-source IDE z AI

- Roo Code — fork Cline

- Kilo Code — lekki edytor z AI

- OpenClaw — platforma agentowa na PC

- Crush — narzędzie do code review

- Goose — asystent programistyczny

Po zasubskrybowaniu GLM-4.7 jest automatycznie dostępny w obsługiwanych narzędziach — bez dodatkowej konfiguracji. Wyczerpanie quoty powoduje automatyczny reset co 5 godzin.

Często zadawane pytania

Czy GLM-5-Turbo jest darmowy?

Nie, GLM-5-Turbo wymaga płatnej subskrypcji GLM Coding Plan. Najtańszy plan Lite kosztuje $10/miesiąc i oferuje dostęp do GLM-4.7, z planowanym dostępem do GLM-5-Turbo w kwietniu 2026. GLM-5 (bez Turbo) jest dostępny jako model open-source.

Jak GLM-5-Turbo wypada względem Claude Opus?

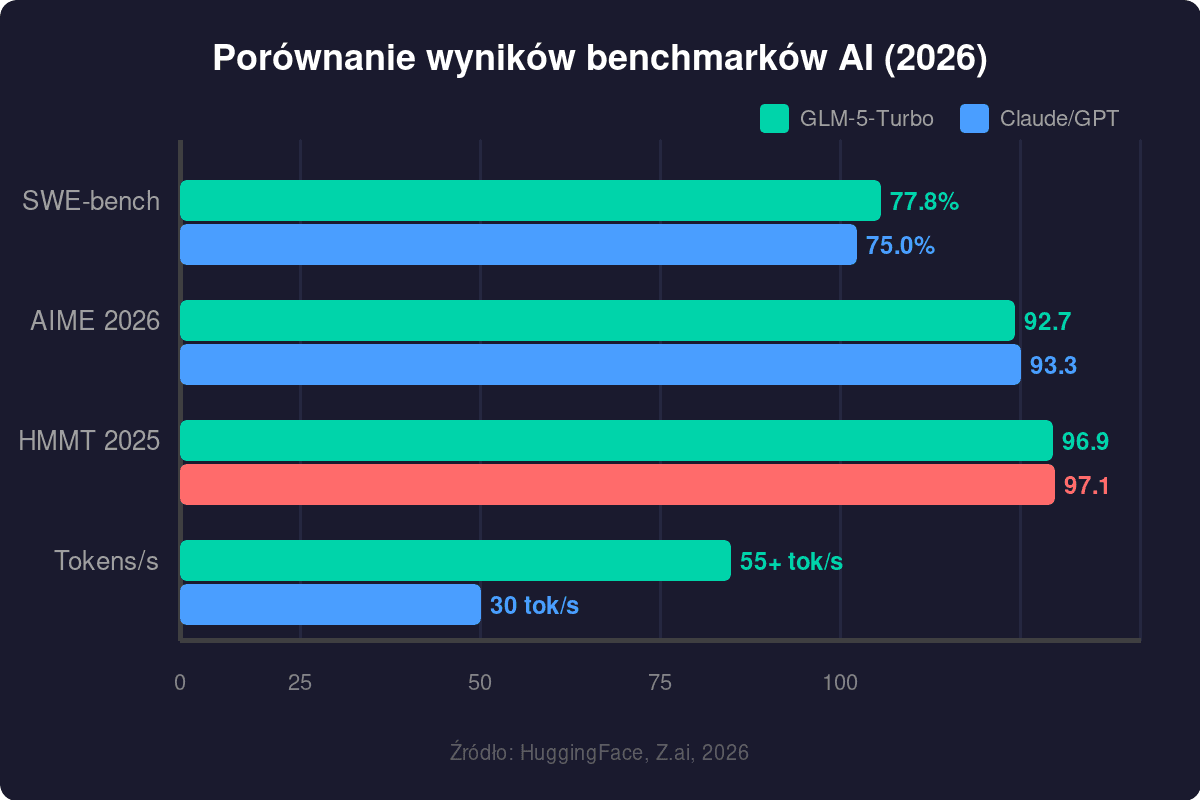

Na benchmarkach AIME 2026 GLM-5 osiąga 92.7 punktów vs 93.3 dla Claude Opus 4.5 — różnica marginalna. GLM-5-Turbo oferuje jednak wyższą prędkość (55+ vs ~30 tokenów/s) i niższą cenę, ale jest modelem closed-source.

Czy mogę używać GLM Coding Plan z własnym API?

Nie, quota planu działa wyłącznie w obsługiwanych narzędziach (Claude Code, Cline, itp.). Oddzielne wywołania API są rozliczane niezależnie i nie korzystają z quoty planu.

Jakie modele są dostępne w GLM Coding Plan?

Wszystkie plany obejmują: GLM-5, GLM-5-Turbo (dostępność zależna od planu), GLM-4.7, GLM-4.6, GLM-4.5 i GLM-4.5-Air. Dostęp do najnowszych modeli (GLM-5, GLM-5-Turbo) wymaga wyższych planów.

Czy GLM-5-Turbo obsługuje język polski?

Tak, GLM-5 jest modelem wielojęzycznym z obsługą 9+ języków w benchmarkach SWE-bench Multilingual. Polska dokumentacja i wsparcie mogą być jednak ograniczone.

Podsumowanie

GLM-5-Turbo to ciekawa alternatywa dla Claude i GPT w zastosowaniach agentowych i workflow programistycznych. Kluczowe atuty to prędkość (55+ tokenów/s), konkurencyjna cena (od $10/miesiąc) i brak limitów sieciowych. Ograniczeniem pozostaje status closed-source i konieczność wyższego planu dla pełnego dostępu.

Jeśli szukasz szybkiego modelu do Claude Code i nie przeszkadza Ci chińskie pochodzenie dostawcy — GLM-5-Turbo wart jest rozważenia. Szczególnie przy intensywnej pracy z automatyzacją i długimi sesjami agentowymi.

Linki: