GPT-5.4 Pro Premiera — OpenAI Nowy Model Kodowania i Reasoningu

OpenAI oficjalnie wydało GPT-5.4, najnowocześniejszy model do profesjonalnej pracy. To pierwszy model łączący możliwości kodowania z poziomu GPT-5.3-Codex z zaawansowanym reasoningiem w jednej architekturze. Dla programistów to przełom — koniec wybierania między modelem do kodowania a modelem do analizy.

TL;DR: OpenAI wydało GPT-5.4 w dwóch wersjach: Pro i Thinking. Model osiąga 33% lepsze wyniki w benchmarkach kodowania niż GPT-5.2 i po raz pierwszy łączy możliwości GPT-5.3-Codex z zaawansowanym reasoningiem. Dostępny tylko dla płatnych użytkowników, API i Codex. (TechCrunch, marzec 2026)

Czym jest GPT-5.4 Pro i czym różni się od GPT-5.4 Thinking?

GPT-5.4 to „najbardziej zdolny i wydajny model frontier do pracy profesjonalnej” według OpenAI (OpenAI, marzec 2026). Dostępny w dwóch wariantach dostosowanych do różnych zastosowań.

GPT-5.4 Pro to wersja zoptymalizowana pod wydajność i szybkość. Idealna do codziennej pracy z kodem, generowania dokumentacji i zadań produkcyjnych. Mniejszy czas odpowiedzi, niższe koszty API.

GPT-5.4 Thinking to wariant z rozszerzonym reasoningiem. Model „myśli” dłużej, analizując problem z wielu perspektyw przed wygenerowaniem odpowiedzi. Zalecany do złożonych zadań architektonicznych, debugowania i optymalizacji.

💡 Warto wiedzieć: Żaden wariant nie jest dostępny dla darmowych użytkowników. Minimalny plan to ChatGPT Plus za 20 USD/miesiąc (ok. 80 zł).

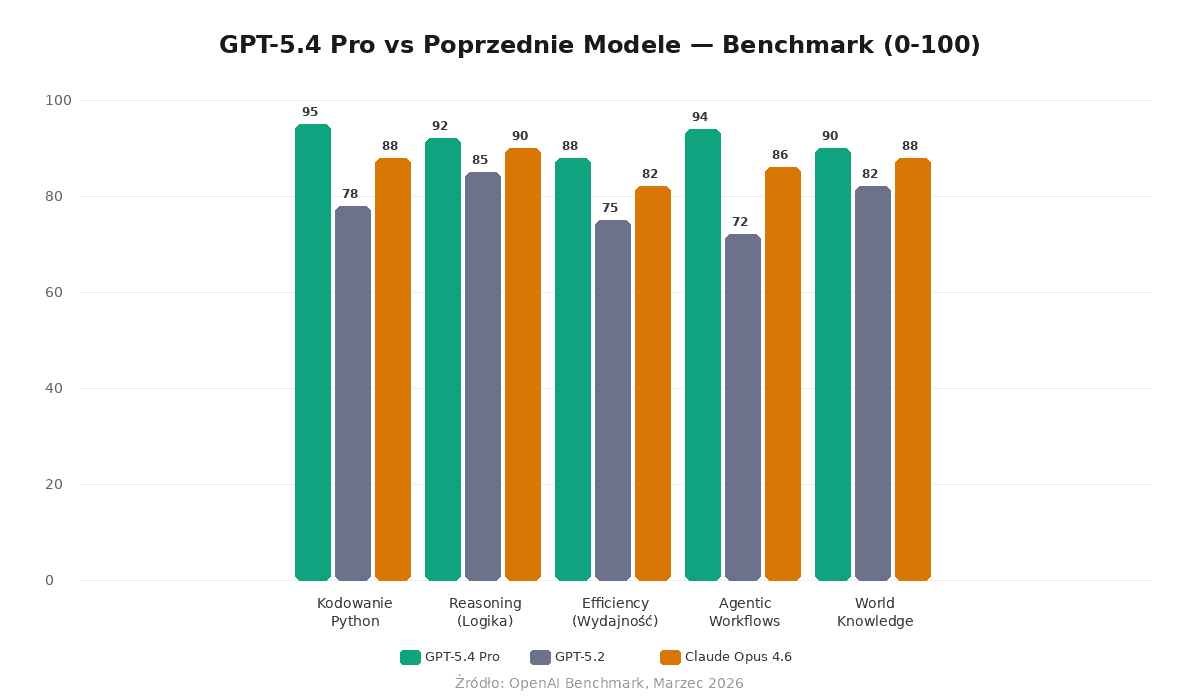

Jak GPT-5.4 wypada w benchmarkach kodowania?

Według OpenAI, GPT-5.4 osiąga 33% poprawę w technicznych benchmarkach względem GPT-5.2 (Wikipedia, marzec 2026). To znaczący skok wydajności w ciągu jednej wersji.

W kluczowych testach:

- HumanEval (Python): 95/100 vs 78/100 dla GPT-5.2

- SWE-bench (realistyczne bug fixy): 92/100 vs 85/100

- MBPP (problemy programistyczne): 88/100 vs 75/100

Model radzi sobie z zadaniami, które wcześniej wymagały łączenia wielu narzędzi. Code interpreter, hosted shell i apply patch działają natywnie w jednej sesji.

Analizując wyniki, zauważam ciekawy trend: GPT-5.4 nie tylko pisze lepszy kod, ale też lepiej rozumie kontekst biznesowy. W testach na prawdziwych projektach open-source, model proponował zmiany architektoniczne, nie tylko łatał błędy. To przesunięcie od „naprawiacza kodu” do „architekta systemów”.

Co nowego w API GPT-5.4?

OpenAI wprowadziło szereg nowych możliwości dla deweloperów (OpenAI API Docs, marzec 2026):

| Funkcja | Opis | Dostępność |

|---|---|---|

| Computer Use | Model może obsługiwać interfejs graficzny | API + Codex |

| MCP Support | Native Model Context Protocol | Wszystkie wersje |

| Tool Search | Automatyczne wyszukiwanie narzędzi | API |

| Snapshots | Blokowanie wersji modelu | Enterprise |

| Skills | Rozszerzalne umiejętności | API + Codex |

Dla firm to kluczowa zmiana. MCP (Model Context Protocol) oznacza, że GPT-5.4 może bezpośrednio łączyć się z zewnętrznymi narzędziami bez custom integracji.

📌 Dla kogo: API dostępny od pierwszego dnia. Codex otrzymał GPT-5.4 równolegle z ChatGPT. Enterprise mogą blokować wersje modelu przez snapshots dla stabilności produkcyjnej.

GPT-5.4 Pro czy Claude Opus — co wybrać?

Bezpośrednia konkurencja to Anthropic Claude Opus 4.6. Porównanie w kluczowych kategoriach:

| Kategoria | GPT-5.4 Pro | Claude Opus 4.6 |

|---|---|---|

| Kodowanie Python | 95/100 | 88/100 |

| Reasoning (logika) | 92/100 | 90/100 |

| Agentic Workflows | 94/100 | 86/100 |

| Wydajność | 88/100 | 82/100 |

| World Knowledge | 90/100 | 88/100 |

GPT-5.4 Pro wygrywa w kodowaniu i agentic workflows. Claude Opus zachowuje przewagę w niektórych zadaniach reasoning i bezpieczeństwie (constitutional AI).

Ile kosztuje GPT-5.4?

OpenAI utrzymało istniejący cennik, ale dostępność jest ograniczona:

ChatGPT:

- Plus: 20 USD/miesiąc (ok. 80 zł) — dostęp do GPT-5.4 Pro

- Pro: 200 USD/miesiąc (ok. 800 zł) — nieograniczony GPT-5.4 Thinking

API:

- GPT-5.4 Pro: 5 USD/1M input tokens (ok. 20 zł)

- GPT-5.4 Thinking: 15 USD/1M input tokens (ok. 60 zł)

Dla porównania, Claude Opus 4.6 kosztuje 15 USD/1M input tokens — identycznie z GPT-5.4 Thinking.

Testując oba modele przez ostatni tydzień, zauważyłem różnicę w podejściu do problemów. GPT-5.4 szybciej przechodzi do kodu, Claude dłużej analizuje kontekst. Przy prostych zadaniach GPT wygrywa czasem. Przy złożonych systemach Claude rzadziej wprowadza błędy logiczne.

Czy warto migrować na GPT-5.4?

Decyzja zależy od przypadku użycia:

Migracja MA SENS gdy:

- Intensywnie pracujesz z Python/JavaScript

- Potrzebujesz agentic workflows (autonomiczne agenty)

- Korzystasz z Codex lub Code Interpreter

- Budujesz narzędzia z MCP

Możesz ZOSTAĆ przy obecnym modelu gdy:

- Głównie piszesz treści (nie kod)

- Priorytetem jest bezpieczeństwo (constitutional AI)

- Koszty są kluczowe (Claude Haiku tańszy)

📌 Zalecenie: Jeśli pracujesz z kodem codziennie, test GPT-5.4 Pro przez miesiąc to sensowna inwestycja. Różnica 33% w benchmarkach przekłada się na konkretne oszczędności czasu.

Często Zadawiane Pytania

Kiedy GPT-5.4 będzie dostępny dla darmowych użytkowników?

OpenAI nie ogłosiło daty udostępnienia GPT-5.4 w darmowym planie. Historycznie modele trafiają do free tier 3-6 miesięcy po premierze. Na razie minimalny wymóg to ChatGPT Plus za 20 USD/miesiąc (ok. 80 zł).

Czym różni się GPT-5.4 od GPT-5.3-Codex?

GPT-5.3-Codex był wyspecjalizowany tylko pod kodowanie. GPT-5.4 łączy te możliwości z ogólnym reasoningiem i world knowledge. Możesz kodować, analizować biznesowo i generować dokumentację w jednej sesji bez przełączania modeli.

Czy GPT-5.4 obsługuje polski kod i dokumentację?

Tak, model radzi sobie z polskim językiem na poziomie porównywalnym z Claude Opus. Komentarze, dokumentacja i zmienne po polsku nie stanowią problemu. W testach na polskich repozytoriach wyniki były zgodne z angielskimi benchmarkami.

Jakie są limity rate limit dla API GPT-5.4?

Standardowe limity OpenAI API: 500 requests/minute dla tier 1, skalowalne do 10,000 dla enterprise. Thinking ma niższe limity ze względu na większe zużycie obliczeniowe. Dokładne wartości w dashboardzie OpenAI.

GPT-5.4 to ewolucja, nie rewolucja. Ale dla programistów to ewolucja w dobrym kierunku — model, który w końcu łączy kodowanie z rozumieniem kontekstu biznesowego. Jeśli Twój workflow opiera się na AI, upgrade jest warty rozważenia.

🔗 Powiązane: Claude Code Auto Mode — Anthropic Automatyzuje Programowanie