Broadcom i Anthropic: 1 gigawatt TPU dla Claude w 2026 — koniec dominacji NVIDIA?

Anthropic właśnie podpisał jedną z największych umów w historii branży AI — 21 miliardów dolarów za dostęp do milion TPU o łącznej mocy ponad 1 gigawatt. Partnerstwo z Broadcom i Google ma przyspieszyć rozwój Claude i zmniejszyć zależność od NVIDIA. Czy to koniec dominacji zielonych?

TL;DR: Anthropic zamawia 1 milion TPU od Broadcom za 21 mld USD, co da startupowi ponad 1 gigawatt mocy obliczeniowej w 2026 roku. To druga co do wielkości umowa na chipy AI w historii, która może podważyć dominację NVIDIA (80% rynku). Broadcom przewiduje wzrost zapotrzebowania do 3 GW w 2027.

Dlaczego Anthropic inwestuje 21 miliardów w TPU?

Anthropic planuje wdrożyć ponad 1 gigawatt nowej mocy obliczeniowej AI do końca 2026 roku, a zapotrzebowanie ma wzrosnąć do 3 gigawatów w 2027 — wynika z raportu TrendForce. Umowa obejmuje dostęp do milion procesorów TPU produkowanych przez Broadcom we współpracy z Google.

To nie jest zwykły zakup sprzętu. To strategiczne partnerstwo, które łączy trzy elementy:

- Google dostarcza projekt TPU i infrastrukturę chmurową

- Broadcom produkuje i sprzedaje chipy bezpośrednio Anthropic

- Anthropic zyskuje niezależność od NVIDIA i dostęp do skalowalnej mocy

Według CNBC, umowa daje Anthropic dostęp do milion TPUv7 Ironwood — najnowszych procesorów Google zaprojektowanych specjalnie pod obciążenia AI. To radykalna zmiana względem modelu opartego wyłącznie na GPU NVIDIA.

Co to oznacza dla dominacji NVIDIA na rynku chipów AI?

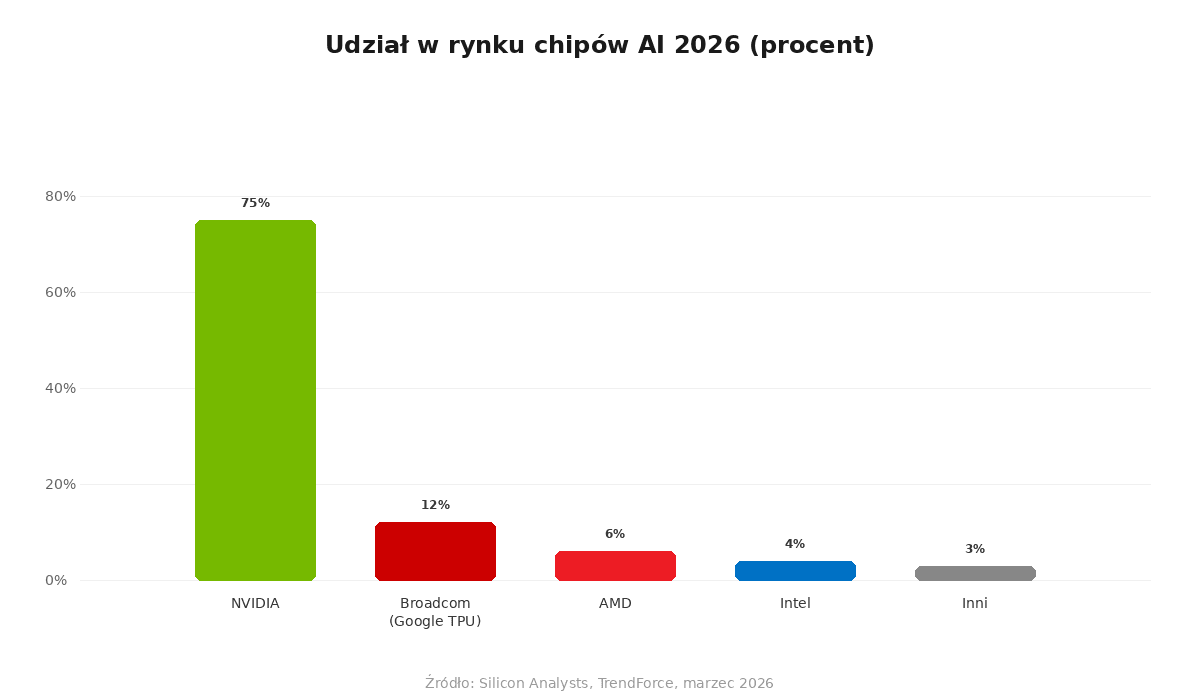

NVIDIA kontroluje około 80% rynku GPU dla AI, ale jej udział spadnie do 75% w 2026 według prognoz Silicon Analysts. Wzrost alternatyw — TPU Google, chipów AMD i custom silicon — przyspiesza.

NVIDIA kontroluje około 80% rynku GPU dla AI, ale jej udział spadnie do 75% w 2026 według prognoz Silicon Analysts. Wzrost alternatyw — TPU Google, chipów AMD i custom silicon — przyspiesza.

Broadcom prognozuje dostawy 3,7 miliona TPU i przychody 60 miliardów dolarów z segmentu AI w 2026. Dla porównania, NVIDIA generuje ponad 100 miliardów dolarów rocznie z data center GPU.

Według danych MIT Technology Review, trening GPT-4 zużył 50 gigawatogodzin energii — wystarczająco, by zasilić San Francisco przez trzy dni. Skala Anthropic (1 GW = 24 GWh dziennie) to zupełnie inna liga obliczeniowa.

Jak wygląda partnerstwo Broadcom-Anthropic-Google?

Umowa łączy trzy filary:

1. Produkcja przez Broadcom

Broadcom inwestuje ponad 3 miliardy dolarów w projekt chipów dla Anthropic. Firma już teraz współpracuje z Google przy produkcji TPU od 2016 roku, więc ma doświadczenie w tej architekturze.

2. Dostęp do chmury Google Cloud

Anthropic zyskuje dostęp do milion TPU w infrastrukturze Google Cloud Platform. To część szerszego partnerstwa z października 2025, które otworzyło Anthropic okno na 1 milion TPU.

3. Custom silicon dla Claude

Anthropic pracuje nad własnymi akceleratorami AI we współpracy z Broadcom. To podąża śladami Google, Meta i Amazon, które rozwijają własne chipy.

Warto zauważyć: to pierwsza tak duża umowa, w której Broadcom sprzedaje TPU bezpośrednio firmie spoza Google. Do tej pory TPU były dostępne wyłącznie przez Google Cloud.

Ile energii zużywa 1 gigawatt mocy obliczeniowej?

1 gigawatt to moc porównywalna z:

- Energia jądrowa — jeden reaktor jądrowy produkuje około 1 GW

- Miasto — wystarczyłoby do zasilania 800 000 domów

- Zużycie — 24 gigawatogodziny dziennie, 8 760 GWh rocznie

Według Deloitte, globalne zużycie energii przez data center ma wzrosnąć do 96 gigawatów do 2026, a AI może odpowiadać za 40% tego zapotrzebowania. Infrastruktura Anthropic to około 1% całkowitej mocy data center na świecie.

To ogromne wyzwanie energetyczne. Anthropic i Google będą musiały inwestować w odnawialne źródła energii, aby utrzymać obietnice redukcji emisji CO2.

Kiedy TPU Anthropic będą gotowe?

| Faza | Moc obliczeniowa | Termin | Źródło |

|---|---|---|---|

| Faza 1 | 1+ gigawatt | Q4 2026 | Broadcom earnings call |

| Faza 2 | 3 gigawatty | 2027 | TrendForce |

| Pełna skala | 1 milion TPU | 2026-2027 | CNBC |

Pierwsze TPUv7 mają zostać dostarczone w drugiej połowie 2026. Broadcom potwierdził na konferencji wyników, że Anthropic to jeden z sześciu kluczowych klientów AI generujących łącznie 100 miliardów dolarów przychodów w 2027.

Czy Anthropic może konkurować z OpenAI i Google DeepMind?

Anthropic zyskuje przewagę infrastrukturalną:

Zalety modelu TPU:

- Niższe koszty operacyjne niż GPU NVIDIA

- Dedykowana architektura pod transformer models

- Dostęp do najnowszych generacji TPUv7

Wyzwania:

- Mniejsze ekosystem narzędzi niż CUDA

- Zależność od jednego dostawcy (Broadcom/Google)

- Skalowanie od zera do 1 GW w 18 miesięcy

Według DataGravity.dev, Anthropic zbudował największą przewagę obliczeniową w branży. Startup ma dostęp do więcej mocy niż OpenAI i konkurentów, co może przełożyć się na lepsze modele Claude.

Z mojej perspektywy jako użytkownika Claude, ta inwestycja tłumaczy gwałtowny wzrost możliwości modelu w ostatnich miesiącach. Claude 4.6 Opus i Sonnet pokazują, że Anthropic nie tylko nadrabia dystans do GPT-5, ale w niektórych zadaniach go przewyższa.

Jak to wpływa na użytkowników Claude?

Bezpośrednie korzyści dla użytkowników:

- Szybsze odpowiedzi — więcej mocy = krótszy czas przetwarzania

- Dłuższy kontekst — 1M tokenów okna kontekstowego wymaga ogromnej pamięci

- Większa dostępność — mniejsze ryzyko przeciążeń i limitów

- Niższe koszty — TPU są tańsze w eksploatacji niż GPU

Anthropic już teraz oferuje największe okno kontekstowe w branży (1 milion tokenów). Dostęp do gigawatta mocy pozwoli utrzymać tę przewagę i rozszerzyć możliwości modelu.

Często zadawane pytania

Czy Anthropic całkowicie odchodzi od NVIDIA?

Nie. Anthropic nadal korzysta z GPU NVIDIA dla części obciążeń, ale TPU staną się główną platformą obliczeniową. To dywersyfikacja, nie całkowita zamiana.

Ile kosztuje trening modelu AI na taką skalę?

Trening GPT-4 kosztował około 100 milionów dolarów i zużył 50 GWh energii. Przy skali Anthropic (1 GW), pełny trening nowego modelu może kosztować miliardy dolarów.

Kiedy zobaczymy efekty tej inwestycji?

Pierwsze efekty w postaci szybszych odpowiedzi i większej dostępności Claude są widoczne już teraz. Główne modele trenowane na nowej infrastrukturze pojawią się w 2027 roku.

Czy to dobra wiadomość dla środowiska?

To skomplikowane. 1 GW to ogromne zapotrzebowanie energetyczne, ale TPU są bardziej energoefektywne niż GPU. Anthropic zobowiązał się do neutralności klimatycznej, więc prawdopodobnie zainwestuje w OZE.

Podsumowanie

Partnerstwo Anthropic-Broadcom-Google to przełomowy moment w rywalizacji o supremację w AI. Anthropic zyskuje dostęp do mocy obliczeniowej, która pozwoli mu konkurować z OpenAI i Google na równych zasadach.

Dla użytkowników Claude to dobra wiadomość — więcej mocy oznacza lepsze modele, szybsze odpowiedzi i stabilniejszą usługę. Dla NVIDIA to sygnał, że dominacja nie jest wieczna.

Rynek chipów AI zmienia się dynamicznie. 2026 rok przyniesie pierwsze rezultaty tej gigantycznej inwestycji.

Źródła: CNBC, TrendForce, Silicon Analysts, MIT Technology Review, Deloitte, DataGravity.dev