Pentagon nazwał Anthropic zagrożeniem narodowym. Sędzia federalna to zablokowała

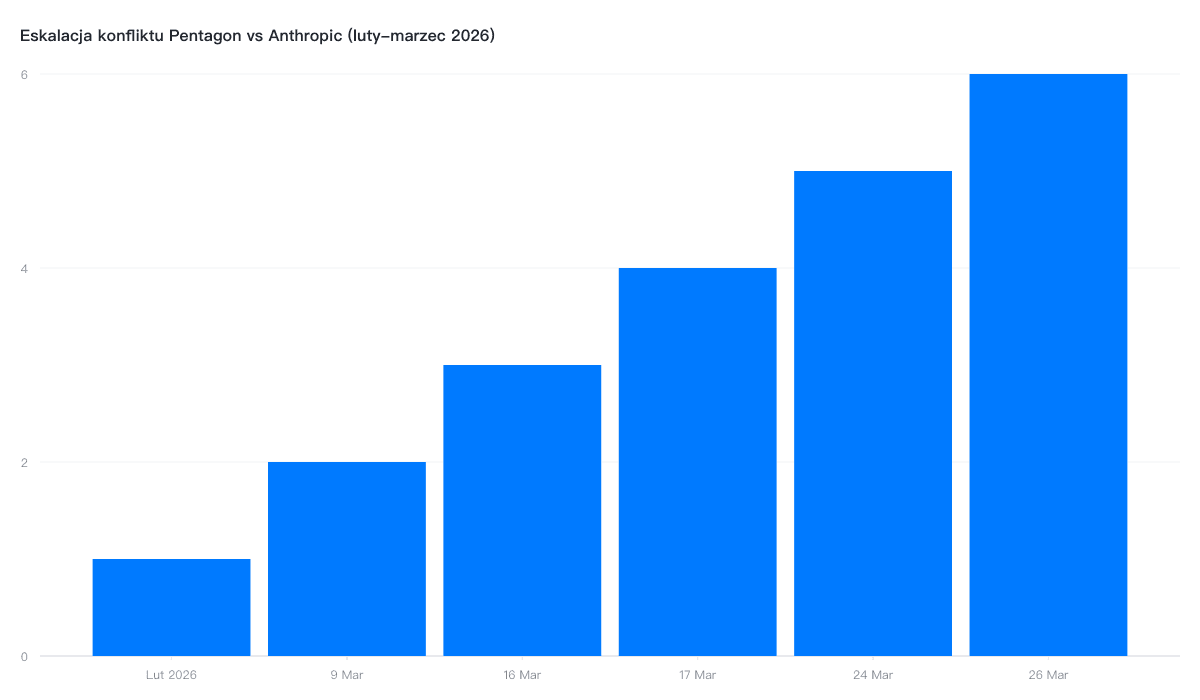

Kiedy sekretarz obrony Pete Hegseth w lutym 2026 roku nazwał Anthropic „zagrożeniem dla łańcucha dostaw narodowych”, setki milionów dolarów w kontraktach rządowych zawisły na włosku. Powód? Firma odmówiła zdjęcia zabezpieczeń z modelu Claude przed użyciem w autonomicznej broni i masowej inwigilacji.

TL;DR: Pentagon wpisał Anthropic (twórców Claude) na czarną listę za odmowę udziału w programie autonomicznej broni. Sędzia federalna Rita Lin zablokowała tę decyzję 26 marca, nazywając ją „klasyczną nielegalną retaliacją za pierwszą poprawkę”. Trzecia strona konfliktu: Microsoft, byli wojskowi i teolodzy poparli Anthropic.

Dlaczego Pentagon wpisał Anthropic na czarną listę?

Konflikt narastał od miesięcy. Anthropic negocjował kontrakt obronny związany z projektem Golden Dome — systemem obrony przeciwrakietowej opartym na sztucznej inteligencji. To kolejny rozdział trwającego napięcia między Anthropic a wojskiem USA, które opisywałem już wcześniej. Firma zażądała klauzul ograniczających użycie Claude do celów autonomicznych systemów bojowych i masowej inwigilacji obywateli. Pentagon odmówił (CNN, marzec 2026).

Po zerwaniu negocjacji Hegseth podjął bezprecedensowy krok: w lutym 2026 roku oznaczył Anthropic jako „zagrożenie dla łańcucha dostaw narodowych” — etykietę normalnie zarezerwowaną dla firm powiązanych z zagranicznymi wywiadami. Prezydent Trump nakazał federalnym agencjom zerwanie relacji z Anthropic i firmami z nim współpracującymi.

Sędzia Rita Lin z sądu federalnego w San Francisco napisała w 43-stronicowym orzeczeniu, że dokumenty Pentagonu wskazują, iż powodem designate było „wrogie zachowanie Anthropic poprzez prasę” — a nie faktyczne zagrożenie bezpieczeństwa.

Co postanowił sąd?

26 marca 2026 roku sędzia Rita Lin na czas nieokreślony zablokowała decyzję Pentagonu, stwierdzając, że działania administracji „najprawdopodobniej naruszyły prawo” i stanowiły retaliację za korzystanie przez Anthropic z Pierwszej Poprawki (AP News, marzec 2026).

„Nic w obowiązującej ustawie nie popiera orwelliańskiej koncepcji, że amerykańska firma może być naznaczona jako potencjalny adwersarz i sabotażysta za wyrażenie niezgody z rządem” — sędzia Rita Lin (CNN, marzec 2026)

Lin dodała, że „karanie Anthropic za przyciągnięcie uwagi publicznej do stanowiska rządu w negocjacjach kontraktowych to klasyczna nielegalna retaliacja za pierwszą poprawkę”. Decyzja oznacza, że Anthropic może nadal ubiegać się o kontrakty rządowe, a agencje federalne nie muszą zrywać z nim relacji. Jak czytałem w dokumentach sądu, to właśnie publiczna krytyka — a nie faktyczne zagrożenie — stała się podstawą designate.

Anthropic stwierdziło, że jest „wdzięczne sądowi za szybkie działanie” i pozostaje skupione na „produktywnej współpracy z rządem dla dobra wszystkich Amerykanów”. Pentagon nie skomentował natychmiast orzeczenia.

Kto poparł Anthropic w tej walce?

To nie jest zwykły spór korporacyjny. Listy amicus curiae (przyjacielskie) złożyło kilkanaście trzecich stron: Microsoft, grupy branżowe technologiczne, szeregowi pracownicy tech, emerytowani dowódcy wojskowi oraz — zaskakująco — grupa teologów katolickich (AP News, marzec 2026).

Koalicja poparcia pokazuje szerokie spektrum: korporacje technologiczne bronią prawa firm do stawiania granic etycznych w AI — wspominałem już, jak Microsoft integruje Claude z Copilot, więc poparcie dla Anthropic jest logiczne. Wojskowi uznają, że bezpieczeństwo wymaga zabezpieczeń, a teolodzy podkreślają moralny wymiar autonomicznej broni.

Co to oznacza dla branży AI?

Orzeczenie sędzie Lin tworzy precedens: rząd USA nie może karać firm AI za odmowę usunięcia zabezpieczeń bezpieczeństwa. Dla branży to sygnał, że etyczne guardrails mają ochronę prawną. Anthropic szacuje, że designate Pentagonu zagroził „setkom milionów dolarów w kontraktach” — ułamkowi przychodów firmy z wyceną ponad 60 miliardów dolarów, ale potężnemu ciosowi symbolicznemu (CNN, marzec 2026).

Śledzę konflikty prawne wokół AI od początku 2026 roku i ten jest pierwszy przypadek, w którym sąd federalny wprost ochronił prawo firmy do odmowy militaryzacji jej technologii. To ważny moment — wcześniej widziałem tylko groźby i retiryczne, ale nigdy tak wyraźny orzek sądu.

Dla użytkowników Claude oznacza to, że zabezpieczenia modelu pozostają nienaruszone. Bez ingerencji wojskowych w guardrails, Claude nadal odmawia odpowiedzi na pytania związane z produkcją broni czy inwigilacją.

Czego nas uczy ta sprawa?

Konflikt Anthropic-Pentagon ilustruje fundamentalne napięcie ery AI: kto decyduje o granicach technologii? Rządy chcą pełnej kontroli nad AI w wojsku. Firmy technologiczne bronią prawa do stawiania etycznych granic. Sądy dopiero zaczynają tworzyć ramy prawne dla tych sporów.

Dla obserwatorów w Polsce sprawa jest istotna: jeśli Pentagon może próbować wymusić usunięcie zabezpieczeń z Claude, inne rządy mogą podjąć podobne kroki. Jak pisałem wcześniej o etyce AI vs kontraktach wojskowych, to napięcie narasta od dawna. Wyrok Lin tworzy precedens prawny, który może być cytowany na całym świecie.

Najczęściej zadawane pytania

Dlaczego Pentagon uznał Anthropic za zagrożenie?

Pentagon użył etykiety „zagrożenie dla łańcucha dostaw narodowych” — mechanizmu normalnie stosowanego wobec firm powiązanych z zagranicznymi wywiadami, np. chińskim Huawei. W przypadku Anthropic powodem był spór o zabezpieczenia w kontrakcie dotyczącym projektu Golden Dome (AP News, marzec 2026).

Czy Claude będzie używany w wojsku?

Tak, ale z ograniczeniami. Anthropic nie odmawia współpracy z wojskiem — domaga się klauzul zabraniających użycia Claude w w pełni autonomicznych systemach bojowych i masowej inwigilacji obywateli USA (CNN, marzec 2026).

Co to jest „supply chain risk”?

To prawny mechanizm z amerykańskiej ustawy o bezpieczeństwie narodowym, pozwalający Pentagonowi zablokować współpracę z firmą uznaną za zagrożenie. Normalnie stosowany wobec dostawców powiązanych z wrogimi państwami. W tym przypadku użyty po raz pierwszy wobec amerykańskiej firmy AI (Reuters, marzec 2026).

Kto jest sędzią Ritą Lin?

Rita Lin to sędzia sądu federalnego w San Francisco. W 43-stronicowym orzeczeniu z 26 marca 2026 roku zablokowała czarną listę Pentagonu, stwierdzając że działania administracji stanowiły nielegalną retaliację za korzystanie z Pierwszej Poprawki (CNN, marzec 2026).

Podsumowanie

Spor między Pentagonem a Anthropic to coś więcej niż spór prawny. To test tego, czy firmy technologiczne mają prawo stawiać granice etyczne swoim produktom — nawet gdy rząd domaga się ich usunięcia. Wyrok sędzie Lin daje nadzieję, że guardrails w AI mają ochronę konstytucyjną. Ale konflikt się nie skończył — Pentagon może odwołać się od decyzji.

Dla użytkowników Claude to dobra wiadomość: zabezpieczenia, które chronią przed użyciem AI w autonomicznej broni, pozostają w mocy. Dla branży — precedensowy sygnał, że prawo stoi po stronie etyki w AI.