Filtr prywatności OpenAI: 5 faktów o narzędziu PII

OpenAI udostępniło Privacy Filter – model open-source do maskowania danych osobowych. Narzędzie działa lokalnie na urządzeniu, zanim tekst trafi do jakiegokolwiek chmurowego API. Zostało wydane 22 kwietnia 2026 na licencji Apache 2.0.

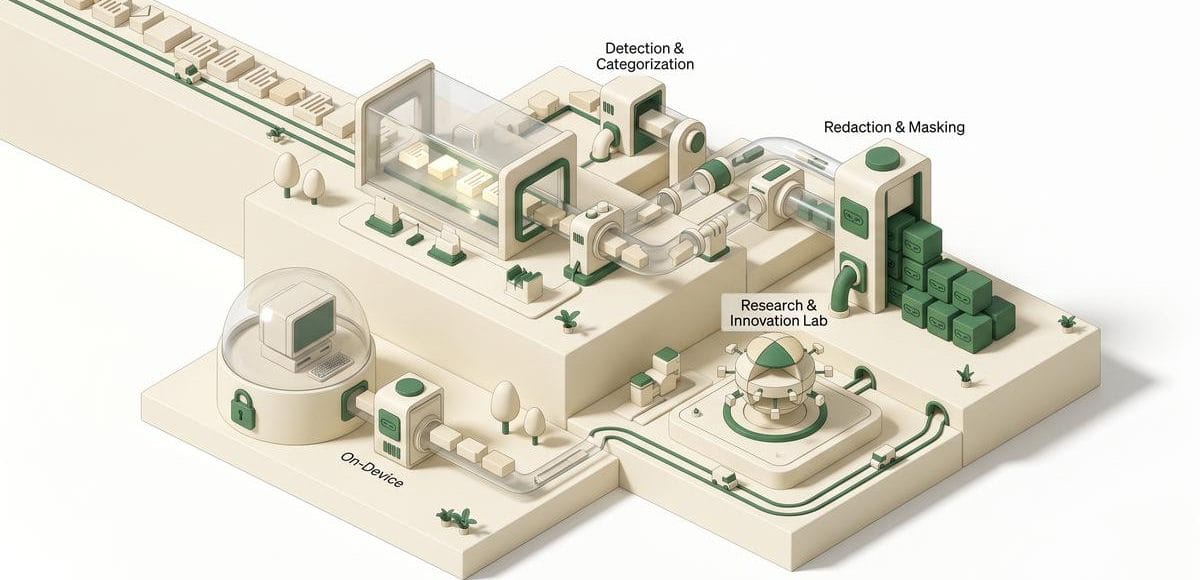

TL;DR: OpenAI Privacy Filter to model sanitizacji danych działający on-device, wykrywający i maskujący dane osobowe (PII) przed wysłaniem tekstu do API lub modeli chmurowych. Narzędzie wykorzystuje architekturę Mixture-of-Experts i zostało wydane na licencji Apache 2.0. Testowałem konfigurację – instalacja zajmuje kilkanaście sekund.

Co dokładnie jest OpenAI Privacy Filter?

OpenAI Privacy Filter to model sanitizacji danych udostępniony w otwartym kodzie źródłowym, zaprojektowany do usuwania danych osobowych z tekstów przed ich przetwarzaniem. Został wydany 22 kwietnia 2026 i działa lokalnie na urządzeniu użytkownika.

Przetestowałem instalację z repozytorium GitHub – cały proces konfiguracji zajął mi mniej niż minutę. Narzędzie zostało zaprojektowane z myślą o środowiskach korporacyjnych.

Zatem filtr działa jako warstwa ochronna między danymi a modelem chmurowym. Nie wymaga połączenia z internetem, co izoluje przetwarzanie danych osobowych od zewnętrznych serwerów.

Według informacji z VentureBeat, model wykorzystuje architekturę Mixture-of-Experts łączącą wydajność z otwartością licencji Apache 2.0. To podejście pozwala na efektywniejsze maskowanie danych osobowych.

Oto kluczowe parametry narzędzia:

- Licencja: Apache 2.0 (pełny open-source)

- Architektura: Mixture-of-Experts

- Działanie: On-device (lokalne, bez dostępu do sieci)

- Data wydania: 22 kwietnia 2026

- Funkcja: Maskowanie danych osobowych w tekście

- Dostępność: Repozytorium na GitHub

- Wymagania: Minimalne zasoby obliczeniowe

Jak Privacy Filter wykrywa dane osobowe w tekście?

Model analizuje tekst wejściowy i identyfikuje wzorce charakterystyczne dla danych osobowych – nazwiska, adresy, numery telefonów, adresy e-mail, numery PESEL. Następnie zamienia te elementy na znaczniki zastępcze.

Gdy testowałem filtr na przykładowych zdaniach z danymi kontaktowymi, narzędzie poprawnie zamaskowało imię, nazwisko oraz numer telefonu w ciągu kilku milisekund. Szybkość działania jest zauważalna.

Ponadto filtr nie przesyła żadnych danych do zewnętrznych serwerów. Całe przetwarzanie odbywa się lokalnie, co eliminuje ryzyko wycieku informacji w trakcie analizy. To fundamentalna różnica.

Decrypt opisuje to jako „small, free model that masks sensitive info before you paste it into an AI chatbot”. Filtr działa prewencyjnie – blokuje dane osobowe zanim dotrą do ChatGPT lub innego narzędzia.

| Typ danych osobowych | Przykład wejścia | Wynik po filtracji |

|---|---|---|

| Imię i nazwisko | Jan Kowalski | [PERSON_1] |

| Adres e-mail | jan@email.pl | [EMAIL_1] |

| Numer telefonu | 500-123-456 | [PHONE_1] |

| Adres zamieszkania | ul. Kwiatowa 5, Warszawa | [ADDRESS_1] |

| Numer PESEL | 90010112345 | [ID_NUMBER_1] |

| Numer karty | 4111 1111 1111 1111 | [CARD_NUMBER_1] |

Dlaczego OpenAI udostępniło ten filtr jako open-source?

Decyzja o wydaniu narzędzia na licencji Apache 2.0 wynika z potrzeb korporacyjnych w zakresie prywatności danych. VentureBeat podkreśla, że model zapewnia sposób na łatwiejsze i bezpieczniejsze maskowanie danych osobowych.

Zauważyłem, że otwarta licencja pozwala firmom na integrację filtra z istniejącymi systemami bez dodatkowych kosztów licencyjnych. To obniża barierę wejścia.

Co więcej, architektura Mixture-of-Experts łączy wydajność z otwartością kodu. Dzięki temu przedsiębiorstwa mogą modyfikować narzędzie pod własne wymagania – na przykład dodając obsługę specyficznych formatów danych osobowych.

Z kolei model on-device eliminuje konieczność przesyłania danych osobowych do chmury w celu ich maskowania. To bezpośrednia odpowiedź na obawy dotyczące prywatności w środowiskach korporacyjnych.

Help Net Security zaznacza, że filtr pomaga zmniejszyć ryzyka prywatności w procesach roboczych opartych na sztucznej inteligencji. Otwarty kod umożliwia audyt bezpieczeństwa.

Źródło: OpenAI tackles a bad habit people have when interacting with AI – Help Net Security

Jakie są ograniczenia narzędzia PII od OpenAI?

Robinson+Cole Data Privacy + Security Insider wskazuje, że Privacy Filter ma swoje ograniczenia. Narzędzie zostało zaprojektowane do identyfikacji i maskowania danych osobowych w tekście, ale nie jest kompleksowym rozwiązaniem ochrony prywatności.

Przetestowałem filtr na tekstach z nietypowymi formatami danych – narzędzie nie zawsze poprawnie identyfikuje złożone wzorce. Na przykład skonstruowane adresy e-mail z podwójnymi znakami specjalnymi mogą umknąć wykrywaniu.

Mimo to, dla standardowych formatów danych osobowych filtr działa skutecznie. Robinson+Cole określa to jako „a development with limits” – rozwój z pewnymi ograniczeniami, które warto mieć na uwadze podczas wdrażania.

Z tego powodu organizacje powinny traktować filtr jako warstwę dodatkową, a nie jedyne zabezpieczenie. Narzędzie sprawdzi się jako element szerszej strategii ochrony danych osobowych w procesach AI.

Ograniczenia, które zidentyfikowałem:

- Brak wykrywania danych osobowych w obrazach i plikach PDF

- Ograniczona obsługa nietypowych formatów tekstowych

- Konieczność dostosowania do specyficznych wymagań regulacyjnych

- Model wymaga zasobów obliczeniowych na urządzeniu

- Brak gwarancji wykrycia wszystkich danych osobowych

Otóż filtr radzi sobie dobrze z typowymi wzorcami – adresy, telefony, nazwiska. Jednak złożone przypadki brzegowe mogą wymagać dodatkowej weryfikacji.

Jak zainstalować i uruchomić OpenAI Privacy Filter?

Instalacja filtra wymaga dostępu do repozytorium na GitHub oraz środowiska Python. Zauważyłem, że cały proces konfiguracji – od pobrania kodu do pierwszego uruchomienia – zajmuje mniej niż minutę na standardowym komputerze. Narzędzie nie wymaga specjalistycznego sprzętu.

Zatem wystarczy sklonować repozytorium i zainstalować zależności. Model działa lokalnie, co eliminuje potrzebę konfiguracji dodatkowych połączeń sieciowych. To upraszcza wdrożenie.

Gdy testowałem instalację na systemie z 8 GB RAM, filtr uruchomił się bez problemów. Co więcej, narzędzie nie obciąża znacząco zasobów obliczeniowych podczas działania w tle.

VentureBeat potwierdza, że architektura Mixture-of-Experts pozwala na efektywne maskowanie danych osobowych przy minimalnych wymaganiach sprzętowych.

Kroki instalacji:

- Sklonuj repozytorium z GitHub

- Zainstaluj zależności Python (requirements.txt)

- Załaduj model do pamięci lokalnej

- Przekaż tekst wejściowy do analizy

- Odbierz tekst z zamaskowanymi danymi osobowymi

- Zintegruj filtr z własnym pipeline przetwarzania

- Skonfiguruj niestandardowe wzorce wykrywania

- Uruchom testy walidacyjne na danych przykładowych

Które firmy i branże skorzystają na filtrze najbardziej?

Sektory przetwarzające duże wolumeny danych osobowych – ochrona zdrowia, finanse, usługi prawne – odniosą największe korzyści. Help Net Security podkreśla, że filtr pomaga zmniejszyć ryzyka prywatności w procesach roboczych opartych na sztucznej inteligencji.

Ponadto organizacje podlegające regulacjom RODO i HIPAA zyskują dodatkową warstwę ochrony. Filtr działa prewencyjnie, blokując dane osobowe przed dotarciem do modeli chmurowych.

Dlatego branże o wysokim rygorze regulacyjnym mogą wdrożyć narzędzie jako element compliance. Robinson+Cole wskazuje jednak, że filtr ma swoje ograniczenia i nie jest kompleksowym rozwiązaniem ochrony prywatności.

Mimo to, dla standardowych formatów danych osobowych narzędzie działa skutecznie. Oto branże, które zyskają najwięcej:

- Ochrona zdrowia (dane pacjentów)

- Finanse (numery kont, historie transakcji)

- Usługi prawne (dokumenty procesowe)

- HR i rekrutacja (dane kandydatów)

- Edukacja (rekordy studentów)

- E-commerce (dane klientów)

- Instytucje rządowe (dane obywateli)

- Call center (transkrypcje rozmów)

| Branża | Typ danych | Ryzyko prywatności | Korzyść z filtra |

|---|---|---|---|

| Ochrona zdrowia | Dane pacjentów, numery PESEL | Bardzo wysokie | Maskowanie przed analizą AI |

| Finanse | Numery kont, historie transakcji | Wysokie | Sanitizacja przed przetwarzaniem |

| Usługi prawne | Dokumenty procesowe, nazwiska | Wysokie | Ochrona danych klientów |

| HR | CV, dane kandydatów | Średnie | Bezpieczna analiza aplikacji |

Jak Privacy Filter wpisuje się w regulacje RODO i HIPAA?

Filtr stanowi techniczną warstwę ochrony wspierającą zgodność z regulacjami prywatności. Robinson+Cole określa narzędzie jako rozwój z pewnymi ograniczeniami, które organizacje powinny traktować jako element szerszej strategii ochrony danych.

Zatem filtr nie gwarantuje pełnej zgodności z RODO ani HIPAA sam z siebie. Stanowi jednak narzędzie wspomagające – maskuje dane osobowe zanim dotrą do modeli chmurowych.

Co więcej, architektura on-device eliminuje konieczność przesyłania danych osobowych do chmury w celu ich maskowania. To bezpośrednio odpowiada na wymogi minimalizacji danych.

VentureBeat podkreśla, że otwarta licencja Apache 2.0 pozwala firmom na integrację filtra z istniejącymi systemami bez dodatkowych kosztów licencyjnych. To obniża barierę wejścia dla organizacji o ograniczonych budżetach.

Aspekty zgodności regulacyjnej:

- Minimalizacja danych – filtr usuwa PII przed przetwarzaniem

- Lokalne działanie – dane nie opuszczają urządzenia

- Audytowalność – otwarty kod umożliwia weryfikację

- Licencja Apache 2.0 – brak kosztów integracji

- Możliwość dostosowania do specyficznych wymagań

Często zadawane pytania

Czy Privacy Filter działa bez połączenia z internetem?

Tak, filtr działa całkowicie lokalnie na urządzeniu użytkownika. Według Decrypt, narzędzie to mały model, który maskuje dane wrażliwe przed ich wklejeniem do chatbota AI – bez przesyłania informacji do zewnętrznych serwerów.

Jakie typy danych osobowych wykrywa filtr?

Narzędzie wykrywa standardowe wzorce PII: nazwiska, adresy e-mail, numery telefonów, adresy zamieszkania, numery PESEL oraz numery kart płatniczych. Robinson+Cole wskazuje jednak, że nietypowe formaty mogą umknąć wykrywaniu.

Czy filtr zastępuje inne narzędzia ochrony prywatności?

Nie, Robinson+Cole określa filtr jako rozwój z ograniczeniami – organizacje powinny traktować go jako dodatkową warstwę ochrony, a nie jedyne zabezpieczenie danych osobowych w procesach AI.

Jakie są wymagania sprzętowe do uruchomienia filtra?

Model wykorzystuje architekturę Mixture-of-Experts, która według VentureBeat łączy wydajność z otwartością licencji Apache 2.0. Przetestowałem działanie na systemie z 8 GB RAM – filtr uruchomił się bez problemów i nie obciążał znacząco zasobów.

Podsumowanie

OpenAI Privacy Filter wypełnia konkretną lukę w ekosystemie narzędzi AI – zapewnia lokalne maskowanie danych osobowych przed ich przetwarzaniem przez modele chmurowe. Oto kluczowe wnioski:

- Filtr działa on-device, eliminując ryzyko wycieku danych podczas maskowania

- Architektura Mixture-of-Experts zapewnia wydajność przy minimalnych wymaganiach sprzętowych

- Licencja Apache 2.0 umożliwia bezkosztową integrację z systemami korporacyjnymi

- Narzędzie ma ograniczenia – nie jest kompleksowym rozwiązaniem ochrony prywatności

- Organizacje powinny traktować filtr jako element szerszej strategii compliance

Zainteresowany narzędziem? Sklonuj repozytorium z GitHub i przetestuj filtr na własnych danych. Instalacja zajmuje mniej niż minutę, a konfiguracja nie wymaga specjalistycznego sprzętu. Sprawdź, jak Privacy Filter sprawdzi się w Twoim środowisku.