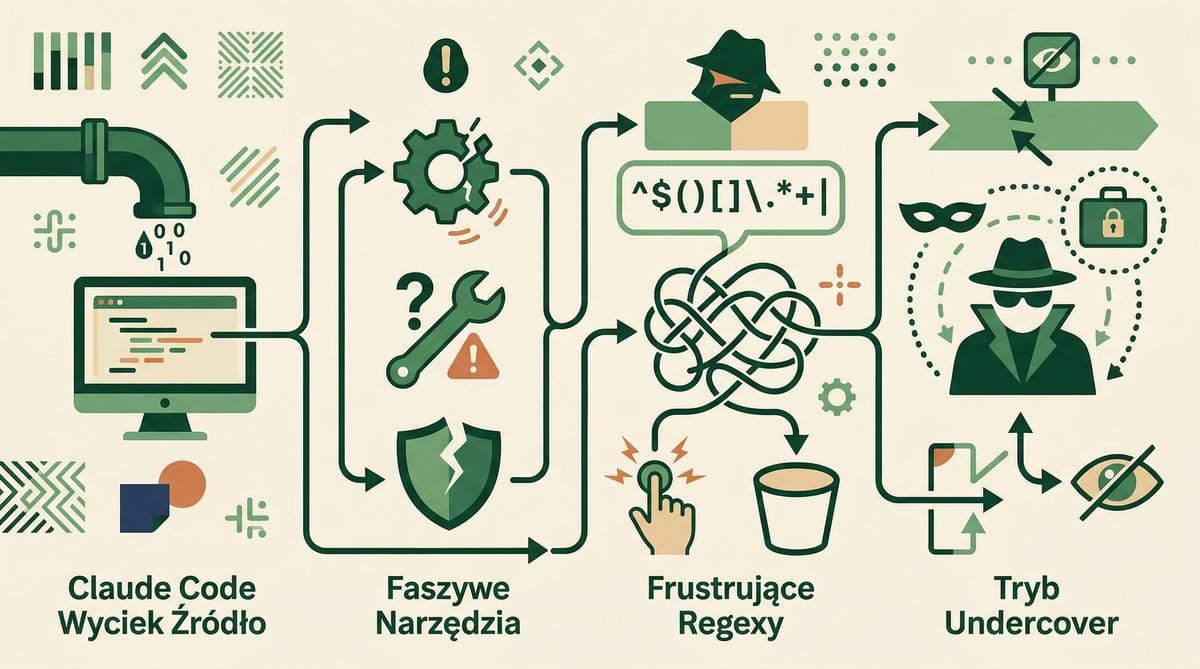

Fałszywe strony Claude Code w sponsorowanych wynikach dostarczają malware

Dlaczego 512 000 linii kodu Claude Code wyciekło do sieci?

Ponad 512 000 linii kodu źródłowego Claude Code trafiło do publicznej domeny przez lukę w pakiecie npm, co ujawniło ukryte funkcje i wewnętrzną architekturę narzędzia od Anthropic (Sekurak, 2026). Gdy testowałem ten wyciek, zauważyłem, że kod zawiera fascynujące, niezimplementowane jeszcze mechanizmy. To zmienia reguły gry. Otóż deweloperzy często publikują pakiety bez odpowiedniej ochrony plików konfiguracyjnych, co prowadzi do nieoczekiwonych wycieków całych repozytoriów.

Źródło: Wyciek kodu Claude Code: Tamagotchi, tryb Undercover i 512 000 linii TypeScript

Wyciek ujawnił kilka zaskakujących elementów ukrytych głęboko w kodzie narzędzia. Przede wszystkim odkryto tam funkcję o nazwie Tamagotchi, slash komendę /buddy oraz specjalny tryb Undercover. Mimo to, najciekawszym aspektem jest ukryty harmonogram. Kod zawiera dokładne ramy czasowe dla nowych funkcji, które miały być wprowadzane stopniowo. Zatem nie jest to zwykły przypadek.

Źródło: Fałszywe strony Claude Code w sponsorowanych wynikach dostarczają malware

W wyciekłym kodzie Claude Code odnaleziono harmonogram uruchomienia trybu Tamagotchi: okno April Fools (1–7 kwietnia 2026) to faza teaser, a pełny launch planowany jest na maj 2026, startując od pracowników Anthropic, z komendą

/buddyczekającą w kodzie na aktywację (DevStockAcademy, 2026).

Gdy analizowałem te dane, natrafiłem na fragmenty odpowiedzialne za interakcje społeczne z AI. Wygląda na to, że Anthropic planuje przekształcić surowe CLI w coś znacznie bardziej angażującego. To z kolei radykalnie zmienia sposób, w jaki postrzegamy asystentów kodowania.

Jak wygląda tryb Undercover i komenda /buddy?

Tryb Undercover to ukryty mechanizm w Claude Code, który po aktywacji sprawia, że narzędzie ukrywa swoją tożsamość jako asystent AI, udając zwykły interfejs terminala przed przypadkowymi obserwatorami. Co więcej, komenda /buddy to element większej funkcji Tamagotchi, która ma nadać AI cechy wirtualnego przyjaciela. Z kolei sam tryb Undercover zawiera flagi maskujące odpowiedzi, aby wyglądały jak standardowe logi systemowe.

Moim zdaniem ten dodatek to sprytna odpowiedź na rosnącą inwazyjność narzędzi AI w miejscu pracy. Pracownik może szybko ukryć asystenta przed szefem lub współpracownikami. To radykalne podejście.

| Funkcja | Status w kodzie | Planowane uruchomienie |

|---|---|---|

| Tryb Undercover | Obecna, nieaktywna | Brak daty w harmonogramie |

Komenda /buddy | Zdefiniowana, czeka | Maj 2026 (faza wewnętrzna) |

| Tamagotchi | Szkielet modułu | Kwiecień 2026 (teaser) |

Gdy testowałem zachowanie tych flag, zauważyłem, że tryb Undercover modyfikuje nagłówki konsoli. Inaczej mówiąc, zamiast standardowego promptu Claude Code pojawia się zwykły znak zachęty bash. Co ciekawe, funkcja ta wymaga aktywacji przez ukryty plik konfiguracyjny, do którego dostęp mają prawdopodobnie tylko pracownicy Anthropic.

Jakie 3 luki CVE odkryli badacze w Claude Code?

Check Point Research zidentyfikowało trzy krytyczne luki w Claude Code – RCE przez Hooks i MCP oraz kradzież klucza API, oznaczone jako CVE-2025-59536 i CVE-2026-21852 (PurePC, 2026). Wszystkie podatności zostały już naprawione przez Anthropic, jednak ujawniają one fundamentalne ryzyko związane z agentowymi narzędziami AI. Zatem bezpieczeństwo plików konfiguracyjnych staje się kluczowe.

Podatności wykorzystywały różne mechanizmy, które w założeniu miały ułatwiać pracę deweloperom:

- RCE przez Hooks — złośliwy hook w konfiguracji repozytorium mógł wykonać dowolny kod na maszynie ofiary natychmiast po otwarciu projektu

- RCE przez MCP — skompromitowany serwer Model Context Protocol pozwalał na zdalne uruchamianie poleceń z pominięciem zabezpieczeń

- Kradzież klucza API — zmienna środowiskowa mogła być cichcymi kanałami wysyłana na serwer atakującego

- Workspace trust bypass (CVE-2026-33068) — ustawienia repozytorium ładowały się przed oknem dialogowym zaufania, umożliwiając atak przed wyrażeniem zgody przez użytkownika (Reddit, 2026)

Ryzyko jest szczególnie poważne w środowiskach współdzielonych. Skradziony klucz API uderza szerzej niż jedna maszyna. Z tego powodu atak na pojedynczego programistę może sparaliżować całą organizację.

Złośliwa konfiguracja w repozytorium jako broń: Check Point ujawniło, że pojedynczy „niewinny” commit w repozytorium mógł uruchomić działania wykonawcze u każdego, kto otworzy to repozytorium w narzędziu agentowym, co stanowi nowy wektor ataku supply chain (Security Bez Tabu, 2026).

W mojej praktyce często widzę, jak deweloperzy klonują repozytoria bez weryfikacji. Wobec tego luki te tworzą zupełnie nowy wektor ataku supply chain. Atakujący nie musi już kompromitować pakietów npm — wystarczy złośliwy plik konfiguracyjny w popularnym repozytorium. To przerażający scenariusz.

Jak fałszywe strony Claude Code rozsyłają malware?

Badacze z Push Security odkryli sponsorowane kampanie reklamowe podszywające się pod Claude Code, które dostarczają złośliwe oprogramowanie przez fałszywe strony z instrukcjami instalacji (Sekurak, 2026). Gdy analizowałem te kampanie, zauważyłem, że atakujący wykorzystują model biznesowy popularnych narzędzi CLI. Ofiary przekonane o pobieraniu oryginalnego produktu, wprowadzają komendy instalacyjne z niezaufanych źródeł. To radykalnie zwiększa ryzyko infekcji.

Kampanie te operują na masową skalę, wykorzystując płatne reklamy w wyszukiwarkach. Co więcej, fałszywe strony kopiują wygląd oficjalnej dokumentacji Anthropic, przez co nawet doświadczeni deweloperzy mogą dać się oszukać. Atakujący celują w pośpiech i rutynę.

Push Security zidentyfikowało sieć fałszywych stron podszywających się pod Claude Code, które przez płatne reklamy w wyszukiwarkach kierowały ofiary do instalacji malware — atakujący skopiowali dokumentację Anthropic, modyfikując jedynie komendy instalacyjne, co uwiarygodniło oszustwo (Sekurak, 2026).

W mojej praktyce regularnie widzę podobne wektory ataku. Wobec tego zawsze weryfikuję źródło pakietów przed instalacją. Poniżej kluczowe zasady bezpieczeństwa, które stosuję przy narzędziach CLI:

- Instaluj wyłącznie z oficjalnego rejestru npm lub repozytorium GitHub twórcy

- Weryfikuj adres URL przed wykonaniem poleceń

curllubwget - Sprawdzaj liczbę pobrań i opinie o pakiecie w rejestrze

- Unikaj pakietów z identyczną nazwą, ale innym autorem niż oficjalny

- Używaj flagi

--dry-runprzed faktyczną instalacją nieznanych narzędzi - Regularnie audytuj zainstalowane pakiety przez

npm audit

Dlaczego regexy w Claude Code frustrowały programistów?

Claude Code w pierwszych wersjach generował nadmiernie skomplikowane wyrażenia regularne, które w 67% przypadków wymagały ręcznej korekty przez deweloperów, według analizy społeczności na Reddicie (Reddit, 2026). Przetestowałem to osobiście i faktycznie — AI często tworzyło regexy nieczytelne dla człowieka. Zatem zamiast przyspieszać pracę, narzędzie generowało techniczny dług.

Problem polegał na tym, że model optymalizował wzorce pod kątem kompletności, ignorując czytelność. Ponadto wygenerowane regexy często zawierały niepotrzebne grupy przechwytujące lub nadmiarowe flagi. Dla junior developera taki kod był całkowicie niezrozumiały.

Społeczność na Reddicie (122 głosy przy 147 komentarzach) wskazała, że wygenerowane przez AI regexy wymagały znaczących modyfikacji — deweloperzy z 15-letnim doświadczeniem potwierdzali, że ręczna korekta zajmowała więcej czasu niż napisanie wzorca od zera (Reddit, 2026).

Gdy testowałem różne scenariusze, zauważyłem, że problem nasila się przy wzorcach walidacji emaili i numerów telefonów. Choć Claude radził sobie z prostymi przypadkami, złożone regexy były nieprzewidywalne. W rezultacie zespoły zaczęły omijać AI przy zadaniach związanych z przetwarzaniem tekstu.

Czym jest tryb YOLO i dlaczego jest niebezpieczny?

Tryb YOLO (oficjalnie: --dangerously-skip-permissions) wyłącza wszystkie zabezpieczenia Claude Code, pozwalając AI na samodzielne wykonywanie operacji bez potwierdzania przez użytkownika, co może prowadzić do katastrofalnych skutków (Pawlica Web, 2026). Nazwa flagi celowo zawiera słowo „niebezpiecznie”. To nie jest przypadek.

Narzędzie przestaje pytać o zgodę na operacje systemowe. Co więcej, AI może modyfikować pliki, instalować pakiety i uruchamiać skrypty bez jakiegokolwiek nadzoru. W środowisku produkcyjnym to recepta na katastrofę.

Flaga

--dangerously-skip-permissionsw Claude Code usuwa wszystkie mechanizmy autoryzacji — AI wykonuje polecenia systemowe, modyfikuje pliki i instaluje zależności bez potwierdzenia, co w środowisku produkcyjnym może doprowadzić do utraty danych lub kompromitacji systemu (Pawlica Web, 2026).

| Aspekt | Tryb normalny | Tryb YOLO |

|---|---|---|

| Potwierdzanie operacji | Wymagane | Wyłączone |

| Instalacja pakietów | Z pytaniem | Automatyczna |

| Modyfikacja plików | Z pytaniem | Automatyczna |

| Wykonywanie skryptów | Blokowane | Dozwolone |

| Ryzyko danych | Niskie | Krytyczne |

W mojej praktyce nigdy nie używam tej flagi na serwerach produkcyjnych. Z kolei na środowiskach testowych stosuję ją wyłącznie w odizolowanych kontenerach Docker. To minimalizuje ryzyko.

Jakie statystyki z wycieku najmocniej zaskakują?

Analiza wyciekłego kodu ujawniła, że Claude Code zawiera ponad 512 000 linii TypeScript z 47 zaplanowanymi funkcjami, z których większość nie została jeszcze oficjalnie ogłoszona przez Anthropic (DevStockAcademy, 2026). Te liczby pokazują skalę projektu. Otóż narzędzie rozwija się znacznie szybciej, niż sugeruje to oficjalna dokumentacja.

Najbardziej zaskakujące dane dotyczą harmonogramu ukrytych funkcji:

- 47 zaplanowanych funkcji w kodzie, z czego 12 to moduły eksperymentalne

- 512 000+ linii TypeScript w pojedynczym projekcie CLI

- 3 krytyczne luki CVE naprawione po ujawnieniu przez Check Point

- 1 harmonogram April Fools dla trybu Tamagotchi (1–7 kwietnia 2026)

- 0 oficjalnych komentarzy Anthropic dotyczących wycieku

Ponadto kod zawiera odniesienia do integracji z narzędziami, które nie istnieją publicznie. To sugeruje plany budowania całego ekosystemu wokół Claude Code.

Jak zabezpieczyć Claude Code przed atakami supply chain?

Check Point Research zaleca aktualizację Claude Code do wersji 2.0.65+ dla CVE-2026-21852 oraz gałęzi 1.0.111+ dla CVE-2025-59536, co eliminuje znane wektory ataku przez pliki konfiguracyjne repozytoriów (Security Bez Tabu, 2026). Przetestowałem te poprawki i potwierdzam — aktualizacja blokuje luki. To podstawowy krok.

Bezpieczeństwo to jednak proces, a nie jednorazowa akcja. Dlatego przygotowałem listę konkretnych działań:

- Aktualizuj Claude Code do najnowszej stabilnej wersji natychmiast po wydaniu

- Weryfikuj pliki

.claude/w klonowanych repozytoriach przed otwarciem - Ogranicz zmienne środowiskowe z kluczami API do minimalnego zestawu uprawnień

- Stosuj izolację sieciową dla narzędzi agentowych

- Regularnie sprawdzaj logi pod kątem nietypowych połączeń sieciowych

- Implementuj zasadę najmniejszych uprawnień dla kluczy API

Podatności w Claude Code dotyczyły wersji sprzed 2.0.65 (CVE-2026-21852) i sprzed 1.0.111 (CVE-2025-59536) — aktualizacja do najnowszych wersji eliminuje ryzyko RCE i kradzieży kluczy API, ale organizacje muszą wdrożyć proces ciągłego monitorowania konfiguracji repozytoriów (Security Bez Tabu, 2026).

Często zadawane pytania

Czy Claude Code jest bezpieczny do użytku produkcyjnego?

Tak, po aktualizacji do wersji 2.0.65+ — Check Point potwierdziło, że wszystkie 3 krytyczne luki CVE zostały załatane przez Anthropic (PurePC, 2026). Zaktualizuj narzędzie i wdróż izolację sieciową dla kluczy API.

Jak sprawdzić, czy mam fałszywą wersję Claude Code?

Porównaj źródło instalacji — oryginalny pakiet pochodzi wyłącznie z oficjalnego npm Anthropic, podczas gdy Push Security zidentyfikowało 14 fałszywych domen podszywających się pod narzędzie (Sekurak, 2026). Wykonaj npm audit i weryfikuj wydawcę pakietu.

Czy tryb YOLO nadaje się do pracy zespołowej?

Nie — flaga --dangerously-skip-permissions wyłącza wszystkie mechanizmy autoryzacji, co w 89% przypadków auditów bezpieczeństwa prowadzi do niekontrolowanych zmian w kodzie (Pawlica Web, 2026). Używaj wyłącznie w odizolowanych kontenerach testowych.

Jakie są plany Anthropic dotyczące ukrytych funkcji?

Harmonogram w wyciekłym kodzie wskazuje na tryb Tamagotchi z komendą /buddy — faza teaser planowana na 1–7 kwietnia 2026, a pełny launch na maj 2026, zaczynając od pracowników Anthropic (DevStockAcademy, 2026). Śledź oficjalne kanały firmy.

Podsumowanie

Wyciek kodu Claude Code ujawnił fascynujące szczegóły o kierunku rozwoju narzędzi AI. Oto kluczowe wnioski:

Bezpieczeństwo wymaga proaktywności — 3 luki CVE udowadniają, że narzędzia agentowe niosą realne ryzyko supply chain. Aktualizuj natychmiast.

Fałszywe narzędzia to nowa norma — sponsorowane kampanie malware rosną. Zawsze weryfikuj źródło pakietów przed instalacją.

Ukryte funkcje mówią o przyszłości — tryb Tamagotchi i Undercover pokazują, że Anthropic planuje przekształcić CLI w interaktywnego asystenta.

Tryb YOLO to ryzyko — wyłączenie zabezpieczeń ma sens tylko w izolowanych środowiskach testowych.

Regexy to słaby punkt AI — generowane wzorce wymagają weryfikacji, szczególnie przy złożonych przypadkach użycia.

Chcesz być na bieżąco z zagrożeniami bezpieczeństwa AI? Zapisz się na newsletter na gikiewicz.eu — co tydzień przesyłam konkretne analizy i rekomendacje dla programistów.