Anthropic oddaje MCP do Linux Foundation — Agentic AI Foundation zmienia zasady gry

Gdy Anthropic, OpenAI i Block — trzej bezpośredni konkurenci — ogłosili wspólną fundację pod szyldem Linux Foundation, branża AI wstrzymała oddech. Model Context Protocol, który zaledwie 16 miesięcy temu był pomysłem jednej firmy, osiągnął 97 milionów instalacji i stał się de facto standardem łączenia agentów AI z zewnętrznymi narzędziami.

TL;DR: Anthropic przekazało MCP (Model Context Protocol) do nowo utworzonej Agentic AI Foundation pod Linux Foundation, współfundowanej z OpenAI i Block. MCP osiągnęło 97 mln instalacji, 10 000+ aktywnych serwerów i adopcję przez ChatGPT, Gemini i Microsoft Copilot. Fundacja zarządza teraz trzema projektami: MCP (Anthropic), Goose (Block) i AGENTS.md (OpenAI), co oznacza neutralne, otwarte standardy dla całego ekosystemu agentów AI.

Czym jest Agentic AI Foundation i dlaczego powstała?

Agentic AI Foundation (AAIF) to specjalny fundusz w strukturze Linux Foundation, powołany 9 grudnia 2025 roku. Anthropic przekazał MCP, Block dodał Goose — framework do budowy agentów AI, a OpenAI wniósł AGENTS.md — standard opisywania kontekstu dla agentów kodujących. Wsparcie zadeklarowały Google, Microsoft, AWS, Cloudflare i Bloomberg (Anthropic, grudzień 2025).

Dlaczego to ważne? Przez ostatni rok każda firma AI budowała własne rozwiązania do łączenia modeli z narzędziami. MCP wygrało tę walkę — nie siłą, lecz otwartością. Przeniesienie go pod neutralny zarząd oznacza, że żaden dostawca nie ma przewagi. To sam model, który sprawdził się w przypadku Kubernetes, Linuxa i HTTP. Anthropic, które wcześniej współzawodniczy z OpenAI o dominację w AI, teraz oddaje swój kluczowy protokół wspólnocie.

Nasz wniosek: MCP powtórzyło trajektorię Kubernetes. Obie technologie powstały wewnątrz jednej firmy (Google→K8s, Anthropic→MCP), szybko zdominowały rynek i trafiły pod neutralny zarząd fundacji. Wzorzec jest powtarzalny — otwarty standard zawsze wygrywa z rozwiązaniem proprietary w infrastrukturze.

MCP — od protokołu Anthropic do 97 milionów instalacji

Model Context Protocol uruchomiono pod koniec 2024 roku jako uniwersalny standard łączenia aplikacji AI z systemami zewnętrznymi. Tempo adopcji przerosło oczekiwania:

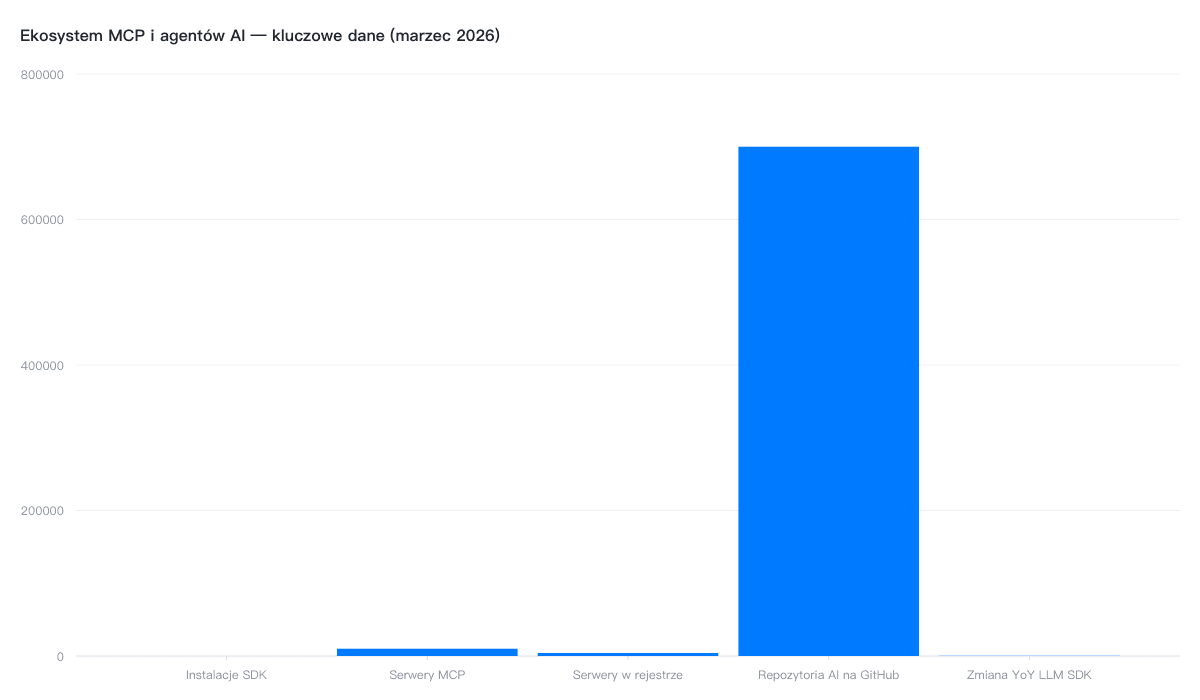

- 97 milionów instalacji SDK w 16 miesięcy (Python + TypeScript) (Digital Applied, marzec 2026)

- 10 000+ aktywnych serwerów MCP publicznych

- 4 000+ serwerów w oficjalnym rejestrze

- Adopcja przez ChatGPT, Cursor, Gemini, Microsoft Copilot, VS Code

- Enterprise deployment: AWS, Cloudflare, Google Cloud, Azure

GitHub odnotował 1,1 miliona publicznych repozytoriów importujących LLM SDK — wzrost o 178% rok do roku. Ponad milion pull requestów wygenerowanych przez agenta codingowego GitHub Copilot w ciągu 5 miesięcy od premiery (GitHub Blog, grudzień 2025).

Trzy projekty pod jedną flagą — co wchodzi w skład AAIF?

Fundacja zarządza trzema komplementarnymi projektami. MCP odpowiada za komunikację agent-narzędzie. Goose dostarcza runtime do budowy i uruchamiania agentów. AGENTS.md standaryzuje sposób, w jaki agenty kodujące rozumieją kontekst projektu.

Jak zauważył Den Delimarsky, główny inżynier Microsoftu i członek komitetu sterującego MCP: „Zrozumiałem problem, który próbowali rozwiązać; zrozumiałem, dlaczego to musi istnieć” (GitHub Blog). Prace Delimarsky’ego nad OAuth dla MCP stały się punktem zwrotnym — wcześniej serwery MCP działały tylko lokalnie, co blokowało adopcję w enterprise.

W marcu 2026 grupa robocza MCP opublikowała Security Standard v1.1, który adresuje ataki prompt injection przez outputy narzędzi, wymogi autentykacji serwerów i wzorce ograniczania scope. Główni enterprise użytkownicy MCP przyjęli v1.1 jako bazę bezpieczeństwa.

Co to oznacza dla programistów i firm?

Dla deweloperów przekazanie MCP pod Linux Foundation ma konkretne konsekwencje. Po pierwsze, neutralność — żaden dostawca modelu nie będzie miał preferencyjnego dostępu do rozwoju protokołu. Po drugie, stabilność — governance model gwarantuje, że standard nie zniknie ani nie zmieni się drastycznie z dnia na dzień. Narzędzia takie jak Claude Code z Agent Teams już korzystają z MCP jako warstwy komunikacji.

Dla enterprise to sygnał, że MCP jest bezpiecznym wyborem jako warstwa infrastruktury. Linux Foundation zarządza takimi projektami jak Kubernetes, SPDX i GraphQL — MCP dołącza do grona technologii krytycznych, utrzymywanych w otwartym modelu. Jak podkreśla Solo.io w swojej analizie, enterprise potrzebuje bezpiecznej infrastruktury agentowej, a otwarty standard to jedyna droga do skalowania (Solo.io, grudzień 2025).

W grupie roboczej MCP zasiadają przedstawiciele Anthropic, Microsoft, GitHub, OpenAI i niezależni deweloperzy. Dodano OAuth flows, sampling semantics, long-running task APIs i server discovery patterns — wszystko to w modelu open source z pełną transparentnością. To istotne dla użytkowników Claude Computer Use, którzy potrzebują bezpiecznej integracji agentów z systemami enterprise.

MCP Dev Summit 2026 — co dalej?

AAIF ogłosiło MCP Dev Summit North America na 2-3 kwietnia 2026 w Nowym Jorku. Konferencja zbiera deweloperów, architektów i decydentów enterprise, aby kształtować kolejną wersję protokołu. Europejska edycja summitu zostanie ogłoszona wkrótce (Linux Foundation, luty 2026).

To istotne z perspektywy polskiego rynku. MCP w modelu open source oznacza dostępność dla polskich firm bez lock-inu do konkretnego dostawcy. Każdy może zbudować serwer MCP, podłączyć go do Claude, ChatGPT czy Gemini i korzystać z tego samego standardu. Zobacz jak Claude Code Auto Mode wykorzystuje MCP do pełnej automatyzacji — to realny przykład mocy otwartego protokołu w praktyce.

Najczęściej zadawane pytania

Czy MCP pozostanie darmowy i otwarty?

Tak. MCP jest od początku open source (licencja MIT) i przekazanie go pod Linux Foundation gwarantuje, że pozostanie darmowy i vendor-neutralny. Governance model wymaga konsensusu między członkami fundacji.

Co to oznacza dla Claude, ChatGPT i Gemini?

Wszystkie trzy platformy obsługują MCP. Neutralny zarząd oznacza, że żaden dostawca nie będzie miał przewagi w integracji — MCP będzie działać identycznie z każdym modelem AI, co korzysta z konkurencji i wyboru użytkowników.

Czym różni się MCP od zwykłego API?

API łączy aplikację z jednym serwisem. MCP to uniwersalny protokół — jeden serwer MCP może obsługiwać wielu klientów AI jednocześnie. To różnica między dedykowanym kablem a USB-C: jeden standard, tysiące urządzeń.

Czy polskie firmy mogą korzystać z MCP w enterprise?

Tak. MCP działa on-premise, w chmurze i hybrydowo. AWS, Google Cloud i Azure oferują natywne wsparcie deploymentu MCP. Security Standard v1.1 zapewnia compliance z wymogami bezpieczeństwa enterprise.

Kto decyduje o rozwoju MCP?

Komitet sterujący MCP w ramach AAIF, złożony z przedstawicieli Anthropic, Microsoft, GitHub, OpenAI i niezależnych deweloperów. Decyzje wymagają konsensusu, a praca jest w pełni jawna.

Podsumowanie

Agentic AI Foundation to więcej niż fundacja — to sygnał, że rynek agentów AI dojrzał do standardów. MCP osiągnęło w 16 miesięcy to, co Kubernetes w 3 lata. Trzech konkurentów połączyło siły, bo otwartość wygrywa z lock-inem. Dla deweloperów i firm to dobra wiadomość: jeden protokół, wszystkie platformy, zero vendor lock-inu.

Jeśli pracujesz z agentami AI — MCP to standard, który musisz znać. A jeśli chcesz zrozumieć, jak agentowe systemy zmieniają rynek pracy, przeczytaj naszą analizę zwolnień w tech 2026.