AI ratuje zespoły bezpieczeństwa przed falą alertów

Ransomware rośnie o 389 procent rok do roku, a 9 na 10 kampanii phishingowych korzysta ze wsparcia sztucznej inteligencji. Zespoły ds. bezpieczeństwa toną w alertach, dlatego sięgają po AI jako jedyną metodę na opanowanie skali zagrożeń.

TL;DR: Cyberprzestępczość przyspiesza dzięki AI – ransomware notuje 389% wzrost ofiar, a phishing w 90% przypadków korzysta z modeli językowych. Zespoły bezpieczeństwa odpowiadają wdrażaniem własnych narzędzi AI do filtrowania alertów i automatyzacji reakcji. Wydatki na cyberbezpieczeństwo wzrosną do ponad 160 mld dol. do 2033 roku.

Jak AI zmienia krajobraz cyberzagrożeń w Polsce i na świecie?

Sztuczna inteligencja przedefiniowała polski krajobraz cyberzagrożeń, tworząc zautomatyzowany ekosystem ataków o niespotykanej dotąd skali. Zgodnie z raportem Fortinet 2026 Global Threat Landscape Report, cyberprzestępczość coraz szybciej przekształca się w zautomatyzowany ekosystem, w którym sztuczna inteligencja przyspiesza rozpoznanie celu, przygotowanie ataku i jego realizację. Tradycyjne systemy bezpieczeństwa nie nadążają za nową skalą zagrożeń.

Ponadto, czas reakcji na ataki cybernetyczne gwałtownie się skraca. Atakujący wykorzystują modele językowe do generowania spersonalizowanych wiadomości phishingowych, omijania filtrów i automatyzacji rozpoznania celu. Polska nie jest wyjątkiem – polskie firmy stają się celem coraz bardziej wyrafinowanych kampanii.

Skala problemu jest ogromna. Ransomware odnotował 389 procent wzrostu ofiar rok do roku, co bezpośrednio wiąże się z wykorzystaniem AI przez cyberprzestępców. Z kolei kampanie phishingowe w prawie 90 procentach przypadków korzystają ze wsparcia sztucznej inteligencji, zgodnie z raportem KnowBe4 Phishing Threat Trends.

To oznacza jedno. Zespoły bezpieczeństwa muszą zmienić podejście.

Dlaczego tradycyjne systemy bezpieczeństwa nie nadążają za zagrożeniami?

Czas reakcji na ataki cybernetyczne gwałtownie się skraca, a tradycyjne systemy bezpieczeństwa nie nadążają za nową skalą zagrożeń. Ręczna analiza alertów staje się niemożliwa, gdy organizacja generuje tysiące zdarzeń dziennie. Analitycy po prostu nie są w stanie przetworzyć tej ilości danych w akceptowalnym czasie.

Z tego powodu, fałszywe alarmy pochłaniają większość czasu pracy zespołów SOC (Security Operations Center). Badania pokazują, że ponad połowa alertów to fałszywe pozytywy, co prowadzi do zmęczenia analityków i przeoczenia rzeczywistych zagrożeń. Problem ten dotyczy szczególnie małych i średnich firm w Polsce.

Cyberprzestępcy wykorzystują ten chaos. Im więcej fałszywych alarmów generuje system, tym łatwiej ukryć prawdziwy atak w szumie informacyjnym. Ataki ransomware, które wzrosły o 389 procent, często rozpoczynają się od prostego wektora dostępu – na przykład phishingu wspieranego przez AI.

Poniżej zestawienie głównych przyczyn przeciążenia alertami:

- Ręczna weryfikacja tysięcy zdarzeń dziennie w centrach SOC

- Ponad 50% fałszywych pozytywów w standardowych systemach detekcji

- Skracający się czas reakcji na incydenty – minuty zamiast godzin

- Brak wykwalifikowanych specjalistów na rynku pracy

- Rosnąca złożoność infrastruktury IT (chmura, IoT, praca zdalna)

- Automatyzacja ataków przez cyberprzestępców wykorzystujących AI

- Fragmentacja narzędzi bezpieczeństwa w organizacjach

- Rosnąca liczba wektorów ataku połączona z brakiem integracji systemów

| Czynnik przeciążający | Wpływ na zespół SOC | Skutek biznesowy |

|---|---|---|

| Fałszywe alarmy (50%+) | Zmęczenie analityków | Przeoczone zagrożenia |

| Brak specjalistów | Przeciążenie pozostałych | Dłuższy czas reakcji |

| Złożoność infrastruktury | Więcej punktów monitorowania | Luki w widoczności |

| Automatyzacja ataków AI | Szybsze, liczniejsze ataki | Wyższe ryzyko incydentu |

Jak ransomware i phishing wykorzystują AI do eskalacji ataków?

Liczba ofiar ataków ransomware wzrosła o 389 procent rok do roku, a prawie 9 na 10 kampanii phishingowych jest wspieranych przez AI. Te dwie liczby definiują nową erę cyberprzestępczości, w której atakujący dysponują narzędziami automatyzującymi każdy etap ataku.

Specjalizująca się w cyberbezpieczeństwie firma KnowBe4 w swoim raporcie Phishing Threat Trends dokumentuje, że internetowi oszuści sięgają po AI w coraz szerszym zakresie. Modele językowe pozwalają na generowanie wiarygodnych, spersonalizowanych wiadomości w wielu językach jednocześnie – w tym po polsku.

Z kolei ransomware wykorzystuje AI do rozpoznawania celu, automatyzacji ruchu lateralnego w sieci i optymalizacji szyfrowania. Jak zauważają autorzy raportu Fortinet 2026 Global Threat Landscape Report, cyberprzestępczość przekształca się w skalowalny ekosystem. Ataki stają się tańsze, szybsze i trudniejsze do wykrycia.

Przestępcy nie muszą być ekspertami. AI robi większość pracy za nich.

Dlaczego wydatki na cyberbezpieczeństwo będą rosły do 2033 roku?

Wydatki na usługi cyberbezpieczeństwa będą rosnąć średnio o 14,8 procent co rok w latach 2026-2033, osiągając ponad 160 miliardów dolarów. Ten wzrost jest bezpośrednią odpowiedzią na eskalację zagrożeń napędzanych przez sztuczną inteligencję.

Organizacje inwestują w narzędzia automatyzacji, platformy SIEM nowej generacji oraz rozwiązania oparte na AI do analizy alertów. Rynek odpowiada na popyt – dostawcy tacy jak Fortinet, CrowdStrike czy Palo Alto Networks integrują możliwości AI ze swoimi produktami. Polska nie pozostaje w tyle, choć tempo adopcji jest zróżnicowane.

Ponadto, regulacje prawne wymuszają wyższe standardy bezpieczeństwa. Dyrektywa NIS2 i RODO narzucają organizacjom obowiązek odpowiedniego zabezpieczania danych i infrastruktury. Niedotrzymanie tych standardów grozi surowymi karami finansowymi.

Koszty rosną. Ale koszty incydentu są wyższe.

Jak zespoły bezpieczeństwa wykorzystują AI do walki z przeciążeniem alertami?

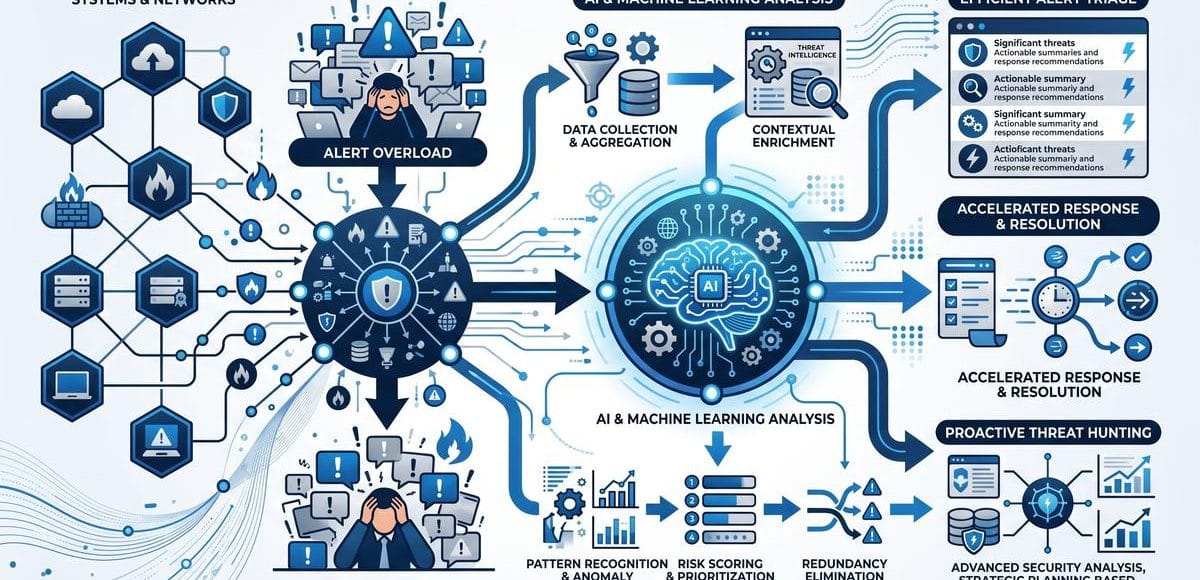

Zespoły ds. bezpieczeństwa sięgają po AI, by poradzić sobie z przeciążeniem alertami – to główny trend w branży na 2026 rok. Automatyzacja analizy zdarzeń pozwala drastycznie zmniejszyć liczbę fałszywych alarmów i skrócić czas reakcji na rzeczywiste incydenty.

Rozwiązania oparte na AI potrafią klasteryzować alerty, łączyć powiązane zdarzenia w jeden incydent i automatycznie weryfikować wiarygodność zagrożenia. Zamiast analizować tysiące pojedynczych alertów, analitycy otrzymują kilkadziesiąt zweryfikowanych incydentów dziennie.

Co więcej, narzędzia AI uczą się na podstawie historycznych danych o incydentach w danej organizacji. Rozpoznają wzorce charakterystyczne dla specyfiki firmy, redukując hałas generowany przez standardowe systemy detekcji. Podobnie jak w przypadku incydentu bezpieczeństwa Vercel z kwietnia 2026 roku, szybka detekcja anomalii jest kluczowa dla ograniczenia szkód.

Automatyzacja to już nie opcja. To konieczność operacyjna.

Jakie konkretne technologie AI stosuje się w centrach SOC?

Centra operacji bezpieczeństwa wdrażają kilka kategorii rozwiązań AI do radzenia sobie z przeciążeniem alertami. Każda z nich adresuje inny aspekt problemu – od detekcji, przez priorytetyzację, aż po automatyczną odpowiedź.

- User and Entity Behavior Analytics (UEBA) – profile zachowań użytkowników i urządzeń, flagują anomalie

- Automatyczna korelacja alertów (SOAR) – łączy powiązane zdarzenia w logiczne incydenty

- Analiza predykcyjna – przewiduje wektory ataku na podstawie danych historycznych

- Automatyczna odpowiedź (playbooki) – izoluje zainfekowane stacje bez czekania na analityka

- NLP do analizy logów – przetwarza niestrukturyzowane dane tekstowe z systemów

- Generatywne AI do raportowania – automatycznie tworzy podsumowania incydentów

Narzędzia te integrują się z istniejącymi systemami SIEM, tworząc warstwę analityczną ponad tradycyjnymi regułami. Jak pokazuje problem opisany w artykule o tym, że nie możesz ufać ustawieniom prywatności i bezpieczeństwa macOS, nawet systemy uważane za bezpieczne wymagają ciągłego monitorowania.

Jakie wyzwania niesie adopcja AI w bezpieczeństwie?

Wdrożenie AI w centrach SOC wiąże się z konkretnymi wyzwaniami technicznymi i organizacyjnymi. Narzędzia AI wymagają jakościowych danych treningowych, a wiele organizacji zmaga się z fragmentacją logów i brakiem standaryzacji formatów zdarzeń.

Z tego powodu, integracja rozwiązań AI z istniejącą infrastrukturą potrafi trwać miesiącami. Organizacje muszą zdefiniować procesy, dostosować architekturę danych i przeszkolić personel. AI nie jest wtyczką, którą wystarczy zainstalować.

Choć narzędzia AI redukują liczbę fałszywych alarmów, same generują nowe kategorie błędów. Halucynacje modeli językowych mogą prowadzić do błędnej klasyfikacji zagrożeń lub przeoczenia rzeczywistych incydentów. Nadzór człowieka pozostaje niezbędny.

AI to narzędzie, nie zastępstwo. Analitycy nadal podejmują decyzje.

Jak wygląda przyszłość wyścigu zbrojeń między atakującymi a obrońcami?

Cyberprzestępcy i zespoły bezpieczeństwa korzystają z tych samych fundamentów technologicznych – modeli językowych, uczenia maszynowego i automatyzacji. Różnica polega na asymetrii: atakujący muszą znaleźć jedną lukę, obrońcy muszą zabezpieczyć wszystkie wektory jednocześnie.

Dlatego wydatki na usługi cyberbezpieczeństwa będą rosły co najmniej do 2033 roku, osiągając ponad 160 mld dol. Organizacje inwestują w narzędzia AI nie z wyboru, lecz z konieczności. Podobnie jak Cloudflare celuje w 2029 rok dla pełnego bezpieczeństwa post-kwantowego, branża przygotowuje się do kolejnej fali zagrożeń.

Ponadto, regulacje takie jak dyrektywa NIS2 wymuszają podniesienie standardów bezpieczeństwa w całej Unii Europejskiej. Polska organizacje muszą dostosować się do nowych wymogów, co napędza popyt na rozwiązania AI w cyberbezpieczeństwie.

Które sektory gospodarki w Polsce są najbardziej narażone na ataki AI?

Polskie sektory finansowe, produkcyjne i medyczne stanowią główne cele dla cyberprzestępców wykorzystujących sztuczną inteligencję. Tradycyjne systemy bezpieczeństwa nie nadążają za nową skalą zagrożeń, co sprawia, że czas reakcji na ataki gwałtownie się skraca (300gospodarka.pl). Zautomatyzowane wektory ataku docierają do infrastruktury krytycznej z bezprecedensową prędkością.

Instytucje finansowe przyciągają atakujących ze względu na bezpośredni dostęp do środków pieniężnych i danych kartowych. Z kolei sektor medyczny gromadzi wrażliwe informacje pacjentów, które stanowią cenny towar na czarnym rynku. Producenci przemysłowi zależą od ciągłości produkcji, co czyni ich idealnymi ofiarami dla operatorów ransomware.

Ponadto, małe i średnie przedsiębiorstwa są szczególnie bezbronne. Często nie dysponują dedykowanymi zespołami SOC, a ich budżety na bezpieczeństwo są marginalne. Cyberprzestępcy o tym wiedzą i celowo automatyzują ataki masowe.

Brak specjalistów pogłębia problem. Firmy walczą o talenty.

Jak organizacje powinny przygotować się do wdrożenia AI w bezpieczeństwie?

Wdrożenie sztucznej inteligencji w centrach operacji bezpieczeństwa wymaga standaryzacji danych i integracji istniejących systemów. Cyberprzestępczość przekształca się w zautomatyzowany ekosystem, w którym AI przyspiesza rozpoznanie celu i realizację ataku (Fortinet 2026 Global Threat Landscape Report, computerworld.pl). Organizacje muszą zbudować fundament analityczny.

Przed wdrożeniem narzędzi analitycznych należy zunifikować format logów i upewnić się, że wszystkie źródła danych są prawidłowo zintegrowane. AI trenowane na fragmentarycznych danych generuje błędne wnioski i pomija istotne zagrożenia.

Poniżej kluczowe kroki przygotowawcze do wdrożenia AI w bezpieczeństwie:

- Audyt istniejących źródeł logów i standaryzacja formatów zdarzeń

- Identyfikacja najczęstszych typów fałszywych alarmów w obecnym systemie

- Wybór konkretnego przypadku użycia na wdrożenie pilotażowe

- Przeszkolenie analityków z interpretacji wyników generowanych przez modele

- Zdefiniowanie procesów eskalacji dla incydentów wykrytych przez AI

- Ustalenie metryk sukcesu dla wdrożenia pilotażowego

Zatem proces wdrożenia wymaga zaangażowania całego zespołu. Nie wystarczy kupić licencję na oprogramowanie.

Jakie błędy popełniają firmy wdrażające AI do cyberbezpieczeństwa?

Najczęstszym błędem organizacji jest traktowanie sztucznej inteligencji jako kompletnej zastępcy dla analityków. Liczba ofiar ataków ransomware wzrosła o 389 procent rok do roku (crn.pl), co napędza presję na szybką automatyzację. Jednak pośpiech prowadzi do krytycznych luk w procesach bezpieczeństwa.

Firmy często wdrażają narzędzia AI bez odpowiedniego nadzoru nad jakością danych treningowych. Modele uczone na niepełnych informacjach powielają błędy i pomijają nietypowe wzorce ataków. Cyberprzestępcy aktywnie szukają sposobów na ominięcie systemów detekcji opartych na uczeniu maszynowym.

Dodatkowo, organizacje pomijają etap testów pilotażowych. Wdrożenie na pełną skalę bez weryfikacji skuteczności modeli w specyficznym środowisku prowadzi do licznych fałszywych negatywów.

Automatyzacja błędnych procesów pogarsza sytuację. Szybkość bez dokładności to ryzyko.

Jakie są realne koszty ignorowania przeciążenia alertami?

Ignorowanie problemu przeciążenia alertami prowadzi bezpośrednio do wydłużenia czasu reakcji na incydenty i wyższych strat finansowych. Wydatki na usługi cyberbezpieczeństwa będą rosnąć średnio o 14,8 procent co roku do 2033 roku (crn.pl), osiągając ponad 160 mld dol. Koszty reakcji na incydenty wielokrotnie przewyższają koszty prewencji.

Organizacje, które nie inwestują w automatyzację analizy zdarzeń, muszą zatrudniać coraz większe zespoły analityków. Na rynku brakuje specjalistów, co napędza koszty wynagrodzeń. Przeciążeni analitycy popełniają błędy, które prowadzą do przeoczenia rzeczywistych zagrożeń.

Ponadto, regulacje takie jak dyrektywa NIS2 nakładają surowe kary za niedostateczne zabezpieczenie infrastruktury. Firma, która nie potrafi wykazać skutecznego zarządzania incydentami, naraża się na sankcje finansowe i utratę reputacji.

Koszty nie działania rosną szybciej niż koszty inwestycji. To czysta matematyka biznesowa.

Często zadawane pytania

Jak AI pomaga w walce z przeciążeniem alertami?

AI automatycznie klasteryzuje alerty, redukując tysiące zdarzeń do kilkudziesięciu zweryfikowanych incydentów. Narzędzia UEBA i SOAR filtrują fałszywe alarmy, które stanowią ponad 50% alertów w tradycyjnych systemach detekcji, pozwalając analitykom skupić się na rzeczywistych zagrożeniach.

Dlaczego ransomware rośnie tak szybko?

Liczba ofiar ransomware wzrosła o 389 procent rok do roku, ponieważ cyberprzestępcy wykorzystują AI do automatyzacji rozpoznania celu i optymalizacji ataku. Ataki stają się tańsze i bardziej skalowalne, co obniża próg wejścia dla przestępców.

Czy AI całkowicie zastąpi analityków bezpieczeństwa?

Nie – AI redukuje hałas alertowy i automatyzuje rutynowe zadania, ale nadzór człowieka pozostaje niezbędny. Modele językowe mogą halucynować, prowadząc do błędnej klasyfikacji zagrożeń. Analitycy podejmują ostateczne decyzje o reakcji na incydenty.

Ile organizacje wydają na cyberbezpieczeństwo?

Wydatki na usługi cyberbezpieczeństwa będą rosnąć średnio o 14,8% rocznie w latach 2026-2033, osiągając ponad 160 mld dol. Ten wzrost jest odpowiedzią na eskalację zagrożeń napędzanych przez AI oraz rosnące wymagania regulacyjne takie jak dyrektywa NIS2.

Czy małe firmy w Polsce również potrzebują AI do bezpieczeństwa?

Małe firmy są celem zautomatyzowanych ataków ransomware, których liczba ofiar wzrosła o 389 proc. rok do roku (crn.pl). Wdrożenie podstawowych narzędzi automatyzacji filtrowania alertów jest konieczne, aby obsłużyć skalę zagrożeń przy ograniczonych zasobach kadrowych.

Jak szybko cyberprzestępcy adaptują nowe modele językowe?

Internetowi oszuści sięgają po AI w coraz szerszym zakresie, co dokumentuje firma KnowBe4 w raporcie Phishing Threat Trends (crn.pl). Nowe modele językowe są wykorzystywane do generowania spersonalizowanych wiadomości phishingowych w prawie 90 procentach kampanii natychmiast po ich udostępnieniu.

Czy dyrektywa NIS2 wymusza wdrażanie rozwiązań AI?

Dyrektywa NIS2 wymaga odpowiedniego poziomu zarządzania incydentami i ochrony infrastruktury. Wydatki na usługi cyberbezpieczeństwa będą rosnąć średnio o 14,8% rocznie do 2033 roku (crn.pl), ponieważ organizacje inwestują w narzędzia AI, aby sprostać wymogom regulacyjnym.

Ile czasu zajmuje wdrożenie AI w centrum SOC?

Wdrożenie narzędzi AI w centrum SOC wymaga standaryzacji danych i integracji systemów, co trwa od kilku tygodni do kilku miesięcy. Cyberprzestępczość przekształca się w zautomatyzowany ekosystem napędzany przez AI (computerworld.pl), dlatego organizacje powinny zacząć od pilotażu ograniczonego do jednego przypadku użycia.

Podsumowanie

AI przedefiniowała krajobraz cyberzagrożeń – ransomware rośnie o 389%, a phishing w 90% przypadków korzysta z modeli językowych. Tradycyjne systemy bezpieczeństwa nie nadążają za skalą i szybkością ataków.

Zespoły ds. bezpieczeństwa sięgają po AI jako odpowiedź na przeciążenie alertami. Automatyzacja analizy zdarzeń, klasteryzacja alertów i priorytetyzacja incydentów to już standard w nowoczesnych centrach SOC.

Wydatki na cyberbezpieczeństwo będą rosły do 2033 roku, osiągając ponad 160 mld dol. Organizacje inwestują w narzędzia AI nie z wyboru, lecz z konieczności obronnej.

Sukces wymaga standaryzacji danych, odpowiedniego nadzoru nad modelami i stopniowego wdrażania rozwiązań. AI to narzędzie wspierające analityków, a nie ich zastępstwo.

Jeśli interesuje Cię wpływ sztucznej inteligencji na inne dziedziny technologii, przeczytaj o tym, jak Szef ds. AI w Apple, John Giannandrea, odchodzi w tym tygodniu lub jak wygląda łagodzenie kompromitacji łańcucha dostaw npm Axios. Sprawdź również, jak Autoresearch Karpathy’ego: Agenci AI, Którzy Sami Testują i Poprawiają Kod zmienia podejście do automatyzacji w programowaniu.